- 最新文章

-

OpenManus 项目部署详细教程 一、项目简介 OpenManus 是一个功能强大的多功能智能代理项目,由来自 MetaGPT 等组织的开发者共同构建。其原型在 3 小时内就已推出,并且团队一直在持续完善。借助 OpenManus,用户无需邀请码就能利用各种工具解决各类任务,实现各种创意。此外,还有与之相关的 OpenManus - RL 开源项目,专注于基于强化学习(如 GRPO)的大语言模型代理调优方法。 二、部署前准备 (一)系统要求 确保你的系统已经安装了以下软件和工具: Python 3.12:OpenManus 项目要求 Python 版本至少为 3.12。 Conda 或 uv:Conda 是一个常用的环境管理工具,而 uv 是一个快速的 Python 包管理器,推荐使用 uv 进行部署。 (二)API 密钥 你需要准备好所使用的大语言模型(LLM)的 API 密钥,例如 OpenAI 的 API 密钥。 不同的大语言模型获取 API 密钥的方式有所不同,以下为你详细介绍几个常见大语言模型 API 密钥的获取方法: 1、OpenAI API 密钥获取 OpenAI 提供了强大的语言模型,如 GPT - 3.5、GPT - 4 等。 步骤 注册账号 访问 OpenAI 官网,点击右上角的 “Sign up” 按钮。 按照提示填写邮箱、设置密码等信息完成注册。注册过程中可能需要进行邮箱验证。 登录控制台 注册成功后,使用注册的账号和密码登录 OpenAI 控制台。 创建 API 密钥 登录控制台后,点击右上角的个人头像,在下拉菜单中选择 “API keys”。 在 API keys 页面,点击 “Create new secret key” 按钮。 输入一个密钥名称(可选),然后点击 “Create secret key”。 此时会弹出一个窗口显示新生成的 API 密钥,这个密钥只会显示一次,务必妥善保存,之后可以将其用于 OpenManus 项目的配置文件中。 注意事项 OpenAI 使用的是付费模式,在使用 API 时会根据使用的额度进行计费。可以在控制台的 “Usage” 页面查看使用情况和费用。 API 密钥是访问 OpenAI 服务的重要凭证,不要将其泄露给他人,以免造成不必要的费用损失。 2、百度千帆大模型平台(以文心一言为例) 百度千帆提供了多种大模型服务,文心一言是其中较为知名的。 步骤 注册并登录 访问 百度千帆大模型平台,点击右上角的 “注册” 按钮,使用百度账号进行注册登录。如果已有百度账号,直接登录即可。 创建应用 登录后,进入控制台,在左侧导航栏中找到 “应用管理” 并点击。 点击 “创建应用” 按钮,填写应用名称、描述等信息,选择所需的模型(如文心一言),点击 “创建”。 获取 API 信息 创建应用成功后,在应用列表中找到刚刚创建的应用,点击进入应用详情页。 在应用详情页中,可以看到 “API Key” 和 “Secret Key”,这两个密钥组合起来用于调用 API 服务。 注意事项 百度千帆平台也有不同的计费策略,使用前需要了解清楚费用情况。 同样要妥善保管好 API Key 和 Secret Key,避免泄露。 3、阿里云通义千问 阿里云的通义千问也是一款优秀的大语言模型。 步骤 注册并开通服务 访问 阿里云官网,注册并登录阿里云账号。 搜索 “通义千问”,进入通义千问的产品页面,点击 “立即开通” 按钮,按照提示完成服务开通流程。 创建 AccessKey 登录阿里云控制台,点击右上角的个人头像,在下拉菜单中选择 “AccessKey 管理”。 如果之前没有创建过 AccessKey,点击 “创建 AccessKey” 按钮,根据提示完成身份验证后生成 AccessKey ID 和 AccessKey Secret。 使用 API 通过阿里云的 SDK 或 API 调用通义千问服务时,使用生成的 AccessKey ID 和 AccessKey Secret 进行身份验证。 注意事项 阿里云的服务使用会根据具体的用量进行计费,需要关注费用情况。 AccessKey 是访问阿里云服务的重要凭证,要严格保密,定期更换。 三、部署步骤 (一)方式一:使用 Conda 部署 创建新的 Conda 环境 打开终端,执行以下命令创建一个名为 open_manus 的 Conda 环境,并激活该环境: bash conda create -n open_manus python=3.12 conda activate open_manus 注意事项: 确保你的 Conda 已经正确安装并且配置好了环境变量,否则可能会提示 conda 命令找不到。 如果创建环境时提示磁盘空间不足,需要清理磁盘或者更换磁盘空间充足的路径创建环境。 克隆仓库 使用 git 命令将 OpenManus 项目的仓库克隆到本地,并进入项目目录: bash git clone https://github.com/mannaandpoem/OpenManus.git cd OpenManus 注意事项: 确保你的网络可以正常访问 GitHub,否则可能会出现克隆失败的情况。你可以尝试使用代理或者切换网络环境。 如果本地已经存在同名的文件夹,克隆操作可能会失败,建议提前删除或者重命名该文件夹。 安装依赖 在项目目录下,使用 pip 安装项目所需的依赖: bash pip install -r requirements.txt 注意事项: 安装依赖可能需要一些时间,具体取决于你的网络速度和服务器响应情况。 如果安装过程中出现依赖冲突的错误,可能是因为某些依赖版本不兼容。可以尝试更新 pip 到最新版本,或者手动指定依赖的版本。 (二)方式二:使用 uv 部署(推荐) 安装 uv 在终端中运行以下命令安装 uv: bash curl -LsSf https://astral.sh/uv/install.sh | sh 注意事项: 确保你的系统中已经安装了 curl 工具,否则命令会执行失败。可以使用 sudo apt-get install curl(Ubuntu/Debian)或者 brew install curl(macOS)来安装。 安装过程可能需要管理员权限,根据提示输入密码进行确认。 克隆仓库 同样使用 git 命令克隆项目仓库并进入项目目录: bash git clone https://github.com/mannaandpoem/OpenManus.git cd OpenManus 注意事项:与使用 Conda 部署时克隆仓库的注意事项相同,确保网络和本地文件夹情况正常。 3. 创建并激活虚拟环境 使用 uv 命令创建虚拟环境,并根据不同的操作系统激活该环境: bash uv venv source .venv/bin/activate # Unix/macOS 系统 Windows 系统使用: .venv\Scripts\activate 注意事项: 对于 Windows 系统,确保在命令提示符或者 PowerShell 中以管理员身份运行,否则可能会出现权限不足的错误。 如果激活虚拟环境后,命令行前缀没有显示虚拟环境名称,可能是激活失败,可以尝试重新执行激活命令。 安装依赖 使用 uv 安装项目所需的依赖: bash uv pip install -r requirements.txt 注意事项:与使用 pip 安装依赖的注意事项类似,关注网络和依赖冲突问题。 四、配置项目 OpenManus 项目需要对所使用的大语言模型(LLM)API 进行配置,具体步骤如下: 创建配置文件 在 config 目录下创建 config.toml 文件,你可以从示例文件复制一份: bash cp config/config.example.toml config/config.toml 注意事项: 确保 config 目录存在,并且你有足够的权限在该目录下创建文件。 复制文件时,要注意文件路径是否正确,避免复制到错误的位置。 编辑配置文件 使用文本编辑器打开 config/config.toml 文件,添加你的 API 密钥并自定义相关设置。以下是一个示例配置: toml #Global LLM configuration [ llm ] model = "gpt-4o" base_url = "https://api.openai.com/v1" api_key = "sk-..." # Replace with your actual API key max_tokens = 4096 temperature = 0.0 #Optional configuration for specific LLM models [ llm.vision ] model = "gpt-4o" base_url = "https://api.openai.com/v1" api_key = "sk-..." # Replace with your actual API key 注意事项: 确保 API 密钥的准确性,任何错误或者遗漏都可能导致 API 认证失败。 不要将包含 API 密钥的配置文件公开分享,以免造成安全风险。 五、启动项目 完成部署和配置后,就可以启动 OpenManus 项目了。 (一)稳定版本启动 在终端中输入以下命令启动稳定版本: bash python main.py 启动后,你可以通过终端输入你的创意,即可开始使用 OpenManus 解决任务。 注意事项: 如果启动过程中出现 ModuleNotFoundError 错误,说明可能有依赖没有正确安装,需要检查并重新安装依赖。 确保你的 API 密钥有效且具有足够的权限,否则可能会在使用过程中遇到请求失败的问题。 (二)开发中版本启动 如果想体验开发中版本,可以运行以下命令: bash python run_flow.py 注意事项:开发中版本可能存在一些不稳定因素,遇到问题可以及时反馈给项目开发者。 六、常见问题及解决方法 (一)依赖安装失败 问题描述:在使用 pip 或 uv 安装依赖时出现错误。 解决方法:检查网络连接是否正常,确保可以访问所需的软件源。如果使用的是国内网络,可以考虑更换为国内的镜像源,例如使用清华大学的 PyPI 镜像源: bash pip install -r requirements.txt -i https://pypi.tuna.tsinghua.edu.cn/simple (二)API 密钥配置错误 问题描述:启动项目后提示 API 认证失败。 解决方法:检查 config.toml 文件中的 API 密钥是否正确,确保没有遗漏或输入错误。同时,要注意 API 密钥的有效期和权限。 七、总结 希望本教程能帮助你顺利部署 OpenManus 项目,享受智能代理带来的便利!

OpenManus 项目部署详细教程 一、项目简介 OpenManus 是一个功能强大的多功能智能代理项目,由来自 MetaGPT 等组织的开发者共同构建。其原型在 3 小时内就已推出,并且团队一直在持续完善。借助 OpenManus,用户无需邀请码就能利用各种工具解决各类任务,实现各种创意。此外,还有与之相关的 OpenManus - RL 开源项目,专注于基于强化学习(如 GRPO)的大语言模型代理调优方法。 二、部署前准备 (一)系统要求 确保你的系统已经安装了以下软件和工具: Python 3.12:OpenManus 项目要求 Python 版本至少为 3.12。 Conda 或 uv:Conda 是一个常用的环境管理工具,而 uv 是一个快速的 Python 包管理器,推荐使用 uv 进行部署。 (二)API 密钥 你需要准备好所使用的大语言模型(LLM)的 API 密钥,例如 OpenAI 的 API 密钥。 不同的大语言模型获取 API 密钥的方式有所不同,以下为你详细介绍几个常见大语言模型 API 密钥的获取方法: 1、OpenAI API 密钥获取 OpenAI 提供了强大的语言模型,如 GPT - 3.5、GPT - 4 等。 步骤 注册账号 访问 OpenAI 官网,点击右上角的 “Sign up” 按钮。 按照提示填写邮箱、设置密码等信息完成注册。注册过程中可能需要进行邮箱验证。 登录控制台 注册成功后,使用注册的账号和密码登录 OpenAI 控制台。 创建 API 密钥 登录控制台后,点击右上角的个人头像,在下拉菜单中选择 “API keys”。 在 API keys 页面,点击 “Create new secret key” 按钮。 输入一个密钥名称(可选),然后点击 “Create secret key”。 此时会弹出一个窗口显示新生成的 API 密钥,这个密钥只会显示一次,务必妥善保存,之后可以将其用于 OpenManus 项目的配置文件中。 注意事项 OpenAI 使用的是付费模式,在使用 API 时会根据使用的额度进行计费。可以在控制台的 “Usage” 页面查看使用情况和费用。 API 密钥是访问 OpenAI 服务的重要凭证,不要将其泄露给他人,以免造成不必要的费用损失。 2、百度千帆大模型平台(以文心一言为例) 百度千帆提供了多种大模型服务,文心一言是其中较为知名的。 步骤 注册并登录 访问 百度千帆大模型平台,点击右上角的 “注册” 按钮,使用百度账号进行注册登录。如果已有百度账号,直接登录即可。 创建应用 登录后,进入控制台,在左侧导航栏中找到 “应用管理” 并点击。 点击 “创建应用” 按钮,填写应用名称、描述等信息,选择所需的模型(如文心一言),点击 “创建”。 获取 API 信息 创建应用成功后,在应用列表中找到刚刚创建的应用,点击进入应用详情页。 在应用详情页中,可以看到 “API Key” 和 “Secret Key”,这两个密钥组合起来用于调用 API 服务。 注意事项 百度千帆平台也有不同的计费策略,使用前需要了解清楚费用情况。 同样要妥善保管好 API Key 和 Secret Key,避免泄露。 3、阿里云通义千问 阿里云的通义千问也是一款优秀的大语言模型。 步骤 注册并开通服务 访问 阿里云官网,注册并登录阿里云账号。 搜索 “通义千问”,进入通义千问的产品页面,点击 “立即开通” 按钮,按照提示完成服务开通流程。 创建 AccessKey 登录阿里云控制台,点击右上角的个人头像,在下拉菜单中选择 “AccessKey 管理”。 如果之前没有创建过 AccessKey,点击 “创建 AccessKey” 按钮,根据提示完成身份验证后生成 AccessKey ID 和 AccessKey Secret。 使用 API 通过阿里云的 SDK 或 API 调用通义千问服务时,使用生成的 AccessKey ID 和 AccessKey Secret 进行身份验证。 注意事项 阿里云的服务使用会根据具体的用量进行计费,需要关注费用情况。 AccessKey 是访问阿里云服务的重要凭证,要严格保密,定期更换。 三、部署步骤 (一)方式一:使用 Conda 部署 创建新的 Conda 环境 打开终端,执行以下命令创建一个名为 open_manus 的 Conda 环境,并激活该环境: bash conda create -n open_manus python=3.12 conda activate open_manus 注意事项: 确保你的 Conda 已经正确安装并且配置好了环境变量,否则可能会提示 conda 命令找不到。 如果创建环境时提示磁盘空间不足,需要清理磁盘或者更换磁盘空间充足的路径创建环境。 克隆仓库 使用 git 命令将 OpenManus 项目的仓库克隆到本地,并进入项目目录: bash git clone https://github.com/mannaandpoem/OpenManus.git cd OpenManus 注意事项: 确保你的网络可以正常访问 GitHub,否则可能会出现克隆失败的情况。你可以尝试使用代理或者切换网络环境。 如果本地已经存在同名的文件夹,克隆操作可能会失败,建议提前删除或者重命名该文件夹。 安装依赖 在项目目录下,使用 pip 安装项目所需的依赖: bash pip install -r requirements.txt 注意事项: 安装依赖可能需要一些时间,具体取决于你的网络速度和服务器响应情况。 如果安装过程中出现依赖冲突的错误,可能是因为某些依赖版本不兼容。可以尝试更新 pip 到最新版本,或者手动指定依赖的版本。 (二)方式二:使用 uv 部署(推荐) 安装 uv 在终端中运行以下命令安装 uv: bash curl -LsSf https://astral.sh/uv/install.sh | sh 注意事项: 确保你的系统中已经安装了 curl 工具,否则命令会执行失败。可以使用 sudo apt-get install curl(Ubuntu/Debian)或者 brew install curl(macOS)来安装。 安装过程可能需要管理员权限,根据提示输入密码进行确认。 克隆仓库 同样使用 git 命令克隆项目仓库并进入项目目录: bash git clone https://github.com/mannaandpoem/OpenManus.git cd OpenManus 注意事项:与使用 Conda 部署时克隆仓库的注意事项相同,确保网络和本地文件夹情况正常。 3. 创建并激活虚拟环境 使用 uv 命令创建虚拟环境,并根据不同的操作系统激活该环境: bash uv venv source .venv/bin/activate # Unix/macOS 系统 Windows 系统使用: .venv\Scripts\activate 注意事项: 对于 Windows 系统,确保在命令提示符或者 PowerShell 中以管理员身份运行,否则可能会出现权限不足的错误。 如果激活虚拟环境后,命令行前缀没有显示虚拟环境名称,可能是激活失败,可以尝试重新执行激活命令。 安装依赖 使用 uv 安装项目所需的依赖: bash uv pip install -r requirements.txt 注意事项:与使用 pip 安装依赖的注意事项类似,关注网络和依赖冲突问题。 四、配置项目 OpenManus 项目需要对所使用的大语言模型(LLM)API 进行配置,具体步骤如下: 创建配置文件 在 config 目录下创建 config.toml 文件,你可以从示例文件复制一份: bash cp config/config.example.toml config/config.toml 注意事项: 确保 config 目录存在,并且你有足够的权限在该目录下创建文件。 复制文件时,要注意文件路径是否正确,避免复制到错误的位置。 编辑配置文件 使用文本编辑器打开 config/config.toml 文件,添加你的 API 密钥并自定义相关设置。以下是一个示例配置: toml #Global LLM configuration [ llm ] model = "gpt-4o" base_url = "https://api.openai.com/v1" api_key = "sk-..." # Replace with your actual API key max_tokens = 4096 temperature = 0.0 #Optional configuration for specific LLM models [ llm.vision ] model = "gpt-4o" base_url = "https://api.openai.com/v1" api_key = "sk-..." # Replace with your actual API key 注意事项: 确保 API 密钥的准确性,任何错误或者遗漏都可能导致 API 认证失败。 不要将包含 API 密钥的配置文件公开分享,以免造成安全风险。 五、启动项目 完成部署和配置后,就可以启动 OpenManus 项目了。 (一)稳定版本启动 在终端中输入以下命令启动稳定版本: bash python main.py 启动后,你可以通过终端输入你的创意,即可开始使用 OpenManus 解决任务。 注意事项: 如果启动过程中出现 ModuleNotFoundError 错误,说明可能有依赖没有正确安装,需要检查并重新安装依赖。 确保你的 API 密钥有效且具有足够的权限,否则可能会在使用过程中遇到请求失败的问题。 (二)开发中版本启动 如果想体验开发中版本,可以运行以下命令: bash python run_flow.py 注意事项:开发中版本可能存在一些不稳定因素,遇到问题可以及时反馈给项目开发者。 六、常见问题及解决方法 (一)依赖安装失败 问题描述:在使用 pip 或 uv 安装依赖时出现错误。 解决方法:检查网络连接是否正常,确保可以访问所需的软件源。如果使用的是国内网络,可以考虑更换为国内的镜像源,例如使用清华大学的 PyPI 镜像源: bash pip install -r requirements.txt -i https://pypi.tuna.tsinghua.edu.cn/simple (二)API 密钥配置错误 问题描述:启动项目后提示 API 认证失败。 解决方法:检查 config.toml 文件中的 API 密钥是否正确,确保没有遗漏或输入错误。同时,要注意 API 密钥的有效期和权限。 七、总结 希望本教程能帮助你顺利部署 OpenManus 项目,享受智能代理带来的便利! -

微语 - 对话即服务-宝塔面板部署 步骤一 步骤二:添加容器编排 复制如下编排内容 最新docker-compose.yaml-需要自行安装ollama 最新docker-compose-ollama.yaml-默认集成ollama 下面是 docker-compose.yaml 内容: services: bytedesk-mysql: image: mysql:latest container_name: mysql-bytedesk environment: MYSQL_DATABASE: bytedesk MYSQL_ROOT_PASSWORD: r8FqfdbWUaN3 ports: - "13306:3306" volumes: - mysql_data:/var/lib/mysql networks: - bytedesk-network bytedesk-redis: image: redis/redis-stack-server:latest container_name: redis-bytedesk ports: - "16379:6379" environment: - REDIS_ARGS=--requirepass qfRxz3tVT8Nh volumes: - redis_data:/data networks: - bytedesk-network bytedesk: # image: bytedesk/bytedesk:latest # hub.docker.com enterprise # image: bytedesk/bytedesk-ce:latest # hub.docker.com community image: registry.cn-hangzhou.aliyuncs.com/bytedesk/bytedesk:latest # aliyun enterprise # mage: registry.cn-hangzhou.aliyuncs.com/bytedesk/bytedesk-ce:latest # aliyun community container_name: bytedesk depends_on: - bytedesk-mysql - bytedesk-redis environment: # db config SPRING_DATASOURCE_URL: jdbc:mysql://mysql-bytedesk:3306/bytedesk?useUnicode=true&characterEncoding=UTF-8&serverTimezone=GMT%2B8&nullCatalogMeansCurrent=true SPRING_DATASOURCE_USERNAME: root SPRING_DATASOURCE_PASSWORD: r8FqfdbWUaN3 SPRING_JPA_HIBERNATE_DDL_AUTO: update # redis config SPRING_DATA_REDIS_HOST: redis-bytedesk SPRING_DATA_REDIS_PORT: 6379 SPRING_DATA_REDIS_PASSWORD: qfRxz3tVT8Nh SPRING_DATA_REDIS_DATABASE: 0 # bytedesk config BYTEDESK_DEBUG: true BYTEDESK_EDITION: enterprise # enable custom config: name, logo, description BYTEDESK_CUSTOM_ENABLED: false BYTEDESK_NAME: BYTEDESK_LOGO: BYTEDESK_DESCRIPTION: BYTEDESK_VERSION: 0.6.4 # Admin config BYTEDESK_ADMIN_EMAIL: admin@email.com BYTEDESK_ADMIN_PASSWORD: admin BYTEDESK_ADMIN_PASSWORD_DEFAULT: 123456 BYTEDESK_ADMIN_NICKNAME: SuperAdmin BYTEDESK_ADMIN_MOBILE: 13345678000 BYTEDESK_ADMIN_MOBILE_WHITELIST: 18888888000,18888888001,18888888002,18888888003,18888888004,18888888005 BYTEDESK_ADMIN_EMAIL_WHITELIST: 100@email.com,101@email.com,102@email.com,103@email.com,104@email.com,105@email.com BYTEDESK_ADMIN_VALIDATE_CODE: 123456 BYTEDESK_ADMIN_FORCE_VALIDATE_MOBILE: true BYTEDESK_ADMIN_FORCE_VALIDATE_EMAIL: true # Organization config BYTEDESK_ORGANIZATION_NAME: MyCompany BYTEDESK_ORGANIZATION_CODE: bytedesk # Features config BYTEDESK_FEATURES_JAVA_AI: false BYTEDESK_FEATURES_PYTHON_AI: true BYTEDESK_FEATURES_EMAIL_TYPE: javamail BYTEDESK_FEATURES_ENABLE_REGISTRATION: false BYTEDESK_FEATURES_AVATAR_BASE_URL: # CORS config # BYTEDESK_CORS_ALLOWED_ORIGINS: * # JWT config BYTEDESK_JWT_SECRET_KEY: 1dfaf8d004207b628a9a6b859c429f49a9a7ead9fd8161c1e60847aeef06dbd2 BYTEDESK_JWT_EXPIRATION: 2592000000 BYTEDESK_JWT_REFRESH_TOKEN_EXPIRATION: 5184000000 # Cache config BYTEDESK_CACHE_LEVEL: 0 BYTEDESK_CACHE_PREFIX: bytedeskim BYTEDESK_CACHE_REDIS_STREAM_KEY: bytedeskim:stream # Upload config BYTEDESK_UPLOAD_TYPE: local BYTEDESK_UPLOAD_DIR: /app/uploads # 上传文件的访问地址,请修改为服务器实际的地址 BYTEDESK_UPLOAD_URL: http://127.0.0.1:9003 # Knowledge base config BYTEDESK_KBASE_THEME: default BYTEDESK_KBASE_HTML_PATH: helpcenter # 知识库的访问地址,请修改为服务器实际的地址 BYTEDESK_KBASE_API_URL: http://127.0.0.1:9003 # Socket config BYTEDESK_SOCKET_HOST: 0.0.0.0 BYTEDESK_SOCKET_WEBSOCKET_PORT: 9885 BYTEDESK_SOCKET_LEAK_DETECTOR_LEVEL: SIMPLE BYTEDESK_SOCKET_PARENT_EVENT_LOOP_GROUP_THREAD_COUNT: 1 BYTEDESK_SOCKET_CHILD_EVENT_LOOP_GROUP_THREAD_COUNT: 8 BYTEDESK_SOCKET_MAX_PAYLOAD_SIZE: 10240 # Cluster config BYTEDESK_CLUSTER_ENABLED: false # Push config # BYTEDESK_PUSH_APNS_BUNDLE_ID: com.kefux.im # BYTEDESK_PUSH_APNS_P12_URL: 123.p12 # BYTEDESK_PUSH_APNS_P12_PASSWORD: 123456 # Actuator security configuration MANAGEMENT_ENDPOINTS_ENABLED_BY_DEFAULT: false MANAGEMENT_ENDPOINTS_WEB_EXPOSURE_INCLUDE: '' MANAGEMENT_ENDPOINTS_WEB_EXPOSURE_EXCLUDE: '*' MANAGEMENT_ENDPOINT_HEALTH_ENABLED: false MANAGEMENT_ENDPOINT_INFO_ENABLED: false MANAGEMENT_SERVER_PORT: -1 MANAGEMENT_ENDPOINTS_WEB_BASE_PATH: '/management' SPRING_SECURITY_BASIC_ENABLED: true # ai config # zhipuai # 申请智谱AI API Key:https://www.bigmodel.cn/usercenter/proj-mgmt/apikeys SPRING_AI_ZHIPUAI_API_KEY: '' SPRING_AI_ZHIPUAI_CHAT_ENABLED: false SPRING_AI_ZHIPUAI_CHAT_OPTIONS_MODEL: glm-4-flash SPRING_AI_ZHIPUAI_CHAT_OPTIONS_TEMPERATURE: 0.7 SPRING_AI_ZHIPUAI_EMBEDDING_ENABLED: false # ollama # ollama pull qwen2.5:1.5b SPRING_AI_OLLAMA_BASE_URL: http://host.docker.internal:11434 SPRING_AI_OLLAMA_CHAT_ENABLED: true # SPRING_AI_OLLAMA_CHAT_OPTIONS_MODEL: deepseek-r1:1.5b SPRING_AI_OLLAMA_CHAT_OPTIONS_MODEL: qwen2.5:1.5b SPRING_AI_OLLAMA_CHAT_OPTIONS_TEMPERATURE: 0.7 SPRING_AI_OLLAMA_EMBEDDING_ENABLED: true SPRING_AI_OLLAMA_EMBEDDING_OPTIONS_MODEL: qwen2.5:1.5b # deepseek # https://docs.spring.io/spring-ai/reference/api/chat/deepseek-chat.html SPRING_AI_DEEPSEEK_API_KEY: 'sk-xxx' SPRING_AI_DEEPSEEK_BASE_URL: https://api.deepseek.com SPRING_AI_DEEPSEEK_CHAT_ENABLED: false SPRING_AI_DEEPSEEK_CHAT_OPTIONS_MODEL: deepseek-chat SPRING_AI_DEEPSEEK_CHAT_OPTIONS_TEMPERATURE: 0.7 SPRING_AI_DEEPSEEK_EMBEDDING_ENABLED: false # openai # https://docs.spring.io/spring-ai/reference/api/chat/openai-chat.html SPRING_AI_OPENAI_API_KEY: 'sk-xxx' SPRING_AI_OPENAI_BASE_URL: https://api.openai.com SPRING_AI_OPENAI_CHAT_ENABLED: false SPRING_AI_OPENAI_CHAT_OPTIONS_MODEL: gpt-4o # SPRING_AI_OPENAI_CHAT_OPTIONS_MODEL: gpt-4o-mini SPRING_AI_OPENAI_CHAT_OPTIONS_TEMPERATURE: 0.7 SPRING_AI_OPENAI_EMBEDDING_ENABLED: false # alibaba # 阿里云百炼大模型获取api key: # https://bailian.console.aliyun.com/?apiKey=1#/api-key # 阿里云百炼大模型模型列表: # https://bailian.console.aliyun.com/?spm=a2c4g.11186623.0.0.11c67980m5X2VR#/model-market SPRING_AI_DASHSCOPE_API_KEY: 'sk-xxx' SPRING_AI_DASHSCOPE_CHAT_ENABLED: false SPRING_AI_DASHSCOPE_CHAT_OPTIONS_MODEL: deepseek-r1 SPRING_AI_DASHSCOPE_CHAT_OPTIONS_TEMPERATURE: 0.7 SPRING_AI_DASHSCOPE_AUDIO_TRANSCRIPTION_ENABLED: false SPRING_AI_DASHSCOPE_IMAGE_ENABLED: false SPRING_AI_DASHSCOPE_EMBEDDING_ENABLED: false SPRING_AI_DASHSCOPE_AUDIO_SYNTHESIS_ENABLED: false SPRING_AI_NACOS_PROMPT_TEMPLATE_ENABLED: false # moonshot SPRING_AI_MOONSHOT_CHAT_ENABLED: false SPRING_AI_MINIMAX_CHAT_ENABLED: false # vector store SPRING_AI_VECTORSTORE_REDIS_INITIALIZE_SCHEMA: true # SPRING_AI_VECTORSTORE_REDIS_URI: redis://:qfRxz3tVT8Nh@redis-bytedesk:6379 SPRING_AI_VECTORSTORE_REDIS_INDEX_NAME: bytedesk_vs_index # SPRING_AI_VECTORSTORE_REDIS_PREFIX: bytedesk_vs_prefix: # mcp SPRING_AI_MCP_CLIENT_ENABLED: false SPRING_AI_MCP_SERVER_ENABLED: false SPRING_AI_MCP_SERVER_STDIO: false SPRING_AI_MCP_SERVER_TYPE: SYNC # weaviate SPRING_AI_VECTORSTORE_WEAVIATE_ENABLED: false # SPRING_MAIN_ALLOW_BEAN_DEFINITION_OVERRIDING: true # wechat config WECHAT_PAY_ENABLED: false # springdoc SPRINGDOC_SHOW_ACTUATOR: false # swagger-ui # http://服务器ip:9003/swagger-ui/index.html SPRINGDOC_SWAGGER_UI_ENABLED: true SPRINGDOC_SWAGGER_UI_PATH: /index.html # api-docs SPRINGDOC_API_DOCS_ENABLED: true SPRINGDOC_API_DOCS_PATH: /v3/api-docs # knife4j # http://服务器ip:9003/doc.html KNIFE4J_ENABLED: true KNIFE4J_SETTING_LANGUAGE: zh_cn ports: - 9003:9003 - 9885:9885 volumes: - upload_data:/app/uploads networks: - bytedesk-network volumes: mysql_data: redis_data: upload_data: networks: bytedesk-network: driver: bridge 因项目默认使用ollama qwen2.5:1.5b模型,所以需要提前拉取模型 基于 docker-compose.yaml 配置文件,ollama拉取 ollama pull deepseek-r1:1.5b ollama pull qwen2.5:1.5b 基于 docker-compose-ollama.yaml 配置文件,使用docker拉取 docker exec ollama pull qwen2.5:1.5b docker exec ollama pull deepseek-r1:1.5b 如果不需要知识库AI问答功能,可以修改 docker-compose.yaml 或 docker-compose-ollama.yaml 关闭ollama对话和嵌入功能,以节省资源 关闭ollama对话 SPRING_AI_OLLAMA_CHAT_ENABLED: false 关闭ollama嵌入 SPRING_AI_OLLAMA_EMBEDDING_ENABLED: false 修改配置,否则上传图片、文件和知识库无法正常显示 修改上述编排文件 请将服务器127.0.0.1替换为你的服务器ip BYTEDESK_UPLOAD_URL: http://127.0.0.1:9003 BYTEDESK_KBASE_API_URL: http://127.0.0.1:9003 步骤三:等待中 步骤四:添加完成,关闭窗口 步骤五:安装成功 步骤六:开放端口 请开放内网入方向端口 • 9003 • 9885 步骤七:预览 请将127.0.0.1替换为你的服务器ip http://127.0.0.1:9003/ 修改默认密码 修改 docker-compose.yaml 文件 或 docker-compose-ollama.yaml 文件 中的默认管理员密码 BYTEDESK_ADMIN_EMAIL: admin@email.com BYTEDESK_ADMIN_PASSWORD: admin 或登录之后在个人资料修改密码

微语 - 对话即服务-宝塔面板部署 步骤一 步骤二:添加容器编排 复制如下编排内容 最新docker-compose.yaml-需要自行安装ollama 最新docker-compose-ollama.yaml-默认集成ollama 下面是 docker-compose.yaml 内容: services: bytedesk-mysql: image: mysql:latest container_name: mysql-bytedesk environment: MYSQL_DATABASE: bytedesk MYSQL_ROOT_PASSWORD: r8FqfdbWUaN3 ports: - "13306:3306" volumes: - mysql_data:/var/lib/mysql networks: - bytedesk-network bytedesk-redis: image: redis/redis-stack-server:latest container_name: redis-bytedesk ports: - "16379:6379" environment: - REDIS_ARGS=--requirepass qfRxz3tVT8Nh volumes: - redis_data:/data networks: - bytedesk-network bytedesk: # image: bytedesk/bytedesk:latest # hub.docker.com enterprise # image: bytedesk/bytedesk-ce:latest # hub.docker.com community image: registry.cn-hangzhou.aliyuncs.com/bytedesk/bytedesk:latest # aliyun enterprise # mage: registry.cn-hangzhou.aliyuncs.com/bytedesk/bytedesk-ce:latest # aliyun community container_name: bytedesk depends_on: - bytedesk-mysql - bytedesk-redis environment: # db config SPRING_DATASOURCE_URL: jdbc:mysql://mysql-bytedesk:3306/bytedesk?useUnicode=true&characterEncoding=UTF-8&serverTimezone=GMT%2B8&nullCatalogMeansCurrent=true SPRING_DATASOURCE_USERNAME: root SPRING_DATASOURCE_PASSWORD: r8FqfdbWUaN3 SPRING_JPA_HIBERNATE_DDL_AUTO: update # redis config SPRING_DATA_REDIS_HOST: redis-bytedesk SPRING_DATA_REDIS_PORT: 6379 SPRING_DATA_REDIS_PASSWORD: qfRxz3tVT8Nh SPRING_DATA_REDIS_DATABASE: 0 # bytedesk config BYTEDESK_DEBUG: true BYTEDESK_EDITION: enterprise # enable custom config: name, logo, description BYTEDESK_CUSTOM_ENABLED: false BYTEDESK_NAME: BYTEDESK_LOGO: BYTEDESK_DESCRIPTION: BYTEDESK_VERSION: 0.6.4 # Admin config BYTEDESK_ADMIN_EMAIL: admin@email.com BYTEDESK_ADMIN_PASSWORD: admin BYTEDESK_ADMIN_PASSWORD_DEFAULT: 123456 BYTEDESK_ADMIN_NICKNAME: SuperAdmin BYTEDESK_ADMIN_MOBILE: 13345678000 BYTEDESK_ADMIN_MOBILE_WHITELIST: 18888888000,18888888001,18888888002,18888888003,18888888004,18888888005 BYTEDESK_ADMIN_EMAIL_WHITELIST: 100@email.com,101@email.com,102@email.com,103@email.com,104@email.com,105@email.com BYTEDESK_ADMIN_VALIDATE_CODE: 123456 BYTEDESK_ADMIN_FORCE_VALIDATE_MOBILE: true BYTEDESK_ADMIN_FORCE_VALIDATE_EMAIL: true # Organization config BYTEDESK_ORGANIZATION_NAME: MyCompany BYTEDESK_ORGANIZATION_CODE: bytedesk # Features config BYTEDESK_FEATURES_JAVA_AI: false BYTEDESK_FEATURES_PYTHON_AI: true BYTEDESK_FEATURES_EMAIL_TYPE: javamail BYTEDESK_FEATURES_ENABLE_REGISTRATION: false BYTEDESK_FEATURES_AVATAR_BASE_URL: # CORS config # BYTEDESK_CORS_ALLOWED_ORIGINS: * # JWT config BYTEDESK_JWT_SECRET_KEY: 1dfaf8d004207b628a9a6b859c429f49a9a7ead9fd8161c1e60847aeef06dbd2 BYTEDESK_JWT_EXPIRATION: 2592000000 BYTEDESK_JWT_REFRESH_TOKEN_EXPIRATION: 5184000000 # Cache config BYTEDESK_CACHE_LEVEL: 0 BYTEDESK_CACHE_PREFIX: bytedeskim BYTEDESK_CACHE_REDIS_STREAM_KEY: bytedeskim:stream # Upload config BYTEDESK_UPLOAD_TYPE: local BYTEDESK_UPLOAD_DIR: /app/uploads # 上传文件的访问地址,请修改为服务器实际的地址 BYTEDESK_UPLOAD_URL: http://127.0.0.1:9003 # Knowledge base config BYTEDESK_KBASE_THEME: default BYTEDESK_KBASE_HTML_PATH: helpcenter # 知识库的访问地址,请修改为服务器实际的地址 BYTEDESK_KBASE_API_URL: http://127.0.0.1:9003 # Socket config BYTEDESK_SOCKET_HOST: 0.0.0.0 BYTEDESK_SOCKET_WEBSOCKET_PORT: 9885 BYTEDESK_SOCKET_LEAK_DETECTOR_LEVEL: SIMPLE BYTEDESK_SOCKET_PARENT_EVENT_LOOP_GROUP_THREAD_COUNT: 1 BYTEDESK_SOCKET_CHILD_EVENT_LOOP_GROUP_THREAD_COUNT: 8 BYTEDESK_SOCKET_MAX_PAYLOAD_SIZE: 10240 # Cluster config BYTEDESK_CLUSTER_ENABLED: false # Push config # BYTEDESK_PUSH_APNS_BUNDLE_ID: com.kefux.im # BYTEDESK_PUSH_APNS_P12_URL: 123.p12 # BYTEDESK_PUSH_APNS_P12_PASSWORD: 123456 # Actuator security configuration MANAGEMENT_ENDPOINTS_ENABLED_BY_DEFAULT: false MANAGEMENT_ENDPOINTS_WEB_EXPOSURE_INCLUDE: '' MANAGEMENT_ENDPOINTS_WEB_EXPOSURE_EXCLUDE: '*' MANAGEMENT_ENDPOINT_HEALTH_ENABLED: false MANAGEMENT_ENDPOINT_INFO_ENABLED: false MANAGEMENT_SERVER_PORT: -1 MANAGEMENT_ENDPOINTS_WEB_BASE_PATH: '/management' SPRING_SECURITY_BASIC_ENABLED: true # ai config # zhipuai # 申请智谱AI API Key:https://www.bigmodel.cn/usercenter/proj-mgmt/apikeys SPRING_AI_ZHIPUAI_API_KEY: '' SPRING_AI_ZHIPUAI_CHAT_ENABLED: false SPRING_AI_ZHIPUAI_CHAT_OPTIONS_MODEL: glm-4-flash SPRING_AI_ZHIPUAI_CHAT_OPTIONS_TEMPERATURE: 0.7 SPRING_AI_ZHIPUAI_EMBEDDING_ENABLED: false # ollama # ollama pull qwen2.5:1.5b SPRING_AI_OLLAMA_BASE_URL: http://host.docker.internal:11434 SPRING_AI_OLLAMA_CHAT_ENABLED: true # SPRING_AI_OLLAMA_CHAT_OPTIONS_MODEL: deepseek-r1:1.5b SPRING_AI_OLLAMA_CHAT_OPTIONS_MODEL: qwen2.5:1.5b SPRING_AI_OLLAMA_CHAT_OPTIONS_TEMPERATURE: 0.7 SPRING_AI_OLLAMA_EMBEDDING_ENABLED: true SPRING_AI_OLLAMA_EMBEDDING_OPTIONS_MODEL: qwen2.5:1.5b # deepseek # https://docs.spring.io/spring-ai/reference/api/chat/deepseek-chat.html SPRING_AI_DEEPSEEK_API_KEY: 'sk-xxx' SPRING_AI_DEEPSEEK_BASE_URL: https://api.deepseek.com SPRING_AI_DEEPSEEK_CHAT_ENABLED: false SPRING_AI_DEEPSEEK_CHAT_OPTIONS_MODEL: deepseek-chat SPRING_AI_DEEPSEEK_CHAT_OPTIONS_TEMPERATURE: 0.7 SPRING_AI_DEEPSEEK_EMBEDDING_ENABLED: false # openai # https://docs.spring.io/spring-ai/reference/api/chat/openai-chat.html SPRING_AI_OPENAI_API_KEY: 'sk-xxx' SPRING_AI_OPENAI_BASE_URL: https://api.openai.com SPRING_AI_OPENAI_CHAT_ENABLED: false SPRING_AI_OPENAI_CHAT_OPTIONS_MODEL: gpt-4o # SPRING_AI_OPENAI_CHAT_OPTIONS_MODEL: gpt-4o-mini SPRING_AI_OPENAI_CHAT_OPTIONS_TEMPERATURE: 0.7 SPRING_AI_OPENAI_EMBEDDING_ENABLED: false # alibaba # 阿里云百炼大模型获取api key: # https://bailian.console.aliyun.com/?apiKey=1#/api-key # 阿里云百炼大模型模型列表: # https://bailian.console.aliyun.com/?spm=a2c4g.11186623.0.0.11c67980m5X2VR#/model-market SPRING_AI_DASHSCOPE_API_KEY: 'sk-xxx' SPRING_AI_DASHSCOPE_CHAT_ENABLED: false SPRING_AI_DASHSCOPE_CHAT_OPTIONS_MODEL: deepseek-r1 SPRING_AI_DASHSCOPE_CHAT_OPTIONS_TEMPERATURE: 0.7 SPRING_AI_DASHSCOPE_AUDIO_TRANSCRIPTION_ENABLED: false SPRING_AI_DASHSCOPE_IMAGE_ENABLED: false SPRING_AI_DASHSCOPE_EMBEDDING_ENABLED: false SPRING_AI_DASHSCOPE_AUDIO_SYNTHESIS_ENABLED: false SPRING_AI_NACOS_PROMPT_TEMPLATE_ENABLED: false # moonshot SPRING_AI_MOONSHOT_CHAT_ENABLED: false SPRING_AI_MINIMAX_CHAT_ENABLED: false # vector store SPRING_AI_VECTORSTORE_REDIS_INITIALIZE_SCHEMA: true # SPRING_AI_VECTORSTORE_REDIS_URI: redis://:qfRxz3tVT8Nh@redis-bytedesk:6379 SPRING_AI_VECTORSTORE_REDIS_INDEX_NAME: bytedesk_vs_index # SPRING_AI_VECTORSTORE_REDIS_PREFIX: bytedesk_vs_prefix: # mcp SPRING_AI_MCP_CLIENT_ENABLED: false SPRING_AI_MCP_SERVER_ENABLED: false SPRING_AI_MCP_SERVER_STDIO: false SPRING_AI_MCP_SERVER_TYPE: SYNC # weaviate SPRING_AI_VECTORSTORE_WEAVIATE_ENABLED: false # SPRING_MAIN_ALLOW_BEAN_DEFINITION_OVERRIDING: true # wechat config WECHAT_PAY_ENABLED: false # springdoc SPRINGDOC_SHOW_ACTUATOR: false # swagger-ui # http://服务器ip:9003/swagger-ui/index.html SPRINGDOC_SWAGGER_UI_ENABLED: true SPRINGDOC_SWAGGER_UI_PATH: /index.html # api-docs SPRINGDOC_API_DOCS_ENABLED: true SPRINGDOC_API_DOCS_PATH: /v3/api-docs # knife4j # http://服务器ip:9003/doc.html KNIFE4J_ENABLED: true KNIFE4J_SETTING_LANGUAGE: zh_cn ports: - 9003:9003 - 9885:9885 volumes: - upload_data:/app/uploads networks: - bytedesk-network volumes: mysql_data: redis_data: upload_data: networks: bytedesk-network: driver: bridge 因项目默认使用ollama qwen2.5:1.5b模型,所以需要提前拉取模型 基于 docker-compose.yaml 配置文件,ollama拉取 ollama pull deepseek-r1:1.5b ollama pull qwen2.5:1.5b 基于 docker-compose-ollama.yaml 配置文件,使用docker拉取 docker exec ollama pull qwen2.5:1.5b docker exec ollama pull deepseek-r1:1.5b 如果不需要知识库AI问答功能,可以修改 docker-compose.yaml 或 docker-compose-ollama.yaml 关闭ollama对话和嵌入功能,以节省资源 关闭ollama对话 SPRING_AI_OLLAMA_CHAT_ENABLED: false 关闭ollama嵌入 SPRING_AI_OLLAMA_EMBEDDING_ENABLED: false 修改配置,否则上传图片、文件和知识库无法正常显示 修改上述编排文件 请将服务器127.0.0.1替换为你的服务器ip BYTEDESK_UPLOAD_URL: http://127.0.0.1:9003 BYTEDESK_KBASE_API_URL: http://127.0.0.1:9003 步骤三:等待中 步骤四:添加完成,关闭窗口 步骤五:安装成功 步骤六:开放端口 请开放内网入方向端口 • 9003 • 9885 步骤七:预览 请将127.0.0.1替换为你的服务器ip http://127.0.0.1:9003/ 修改默认密码 修改 docker-compose.yaml 文件 或 docker-compose-ollama.yaml 文件 中的默认管理员密码 BYTEDESK_ADMIN_EMAIL: admin@email.com BYTEDESK_ADMIN_PASSWORD: admin 或登录之后在个人资料修改密码 -

Linux运维常用一键脚本 一键安装Apache服务器 #!/bin/bash sudo apt-get update sudo apt-get install -y apache2 sudo systemctl start apache2 sudo systemctl enable apache2 echo "Apache服务器已安装并启动" 功能用途:自动化安装并启动Apache服务器。 一键安装MySQL数据库 #!/bin/bash sudo apt-get update sudo apt-get install -y mysql-server sudo mysql_secure_installation sudo systemctl start mysql sudo systemctl enable mysql echo "MySQL数据库已安装并启动" 功能用途:自动化安装MySQL数据库,并提示进行安全配置。 一键备份MySQL数据库 #!/bin/bash USER="your_mysql_user" PASSWORD="your_mysql_password" DB_NAME="your_database_name" BACKUP_DIR="/path/to/backup" DATE=$(date +"%Y-%m-%d") mysqldump -u $USER -p$PASSWORD $DB_NAME > $BACKUP_DIR/$DB_NAME-$DATE.sql echo "数据库已备份到 $BACKUP_DIR" 功能用途:备份指定的MySQL数据库到指定目录。 一键安装Nginx #!/bin/bash sudo apt-get update sudo apt-get install -y nginx sudo systemctl start nginx sudo systemctl enable nginx echo "Nginx服务器已安装并启动" 功能用途:自动化安装并启动Nginx服务器。 一键配置防火墙 #!/bin/bash sudo ufw allow 'Nginx Full' sudo ufw allow 'OpenSSH' sudo ufw enable sudo ufw status echo "防火墙已配置并启用" 功能用途:配置防火墙以允许Nginx和SSH服务。 一键更新系统 #!/bin/bash sudo apt-get update sudo apt-get upgrade -y sudo apt-get dist-upgrade -y sudo reboot echo "系统已更新并重启" 功能用途:更新系统软件包,并重启系统以应用更改。 一键安装Docker #!/bin/bash sudo apt-get update sudo apt-get install -y apt-transport-https ca-certificates curl software-properties-common curl -fsSL https://download.docker.com/linux/ubuntu/gpg | sudo apt-key add - sudo add-apt-repository "deb https://download.docker.com/linux/ubuntu $(lsb_release -cs) stable" sudo apt-get update sudo apt-get install -y docker-ce sudo systemctl start docker sudo systemctl enable docker sudo usermod -aG docker $USER echo "Docker已安装并启动,用户已添加到docker组" 功能用途:自动化安装Docker,并将当前用户添加到docker组。 一键清理系统日志 #!/bin/bash sudo find /var/log/ -type f -name "*.log" -exec truncate -s 0 {} \; echo "系统日志已清理" 功能用途:清空系统日志文件。 一键安装PHP #!/bin/bash sudo apt-get update sudo apt-get install -y php libapache2-mod-php php-mysql sudo systemctl restart apache2 echo "PHP已安装并配置为Apache模块" 功能用途:安装PHP及其Apache模块,以便在Apache服务器上运行PHP代码。 一键监控CPU和内存使用率 #!/bin/bash watch -n 1 'free -m && top -bn1 | grep "Cpu(s)"' 功能用途:实时监控CPU和内存使用率。 一键查找大文件 #!/bin/bash sudo find / -type f -size +100M -exec ls -lh {} \; | awk '{ print $9 ": " $5 }' 功能用途:查找系统中大于100MB的文件。 一键安装Git #!/bin/bash sudo apt-get update 一键安装Node.js #!/bin/bash VERSION="node_14.x" # 可以根据需要更改版本 DISTRO=$(lsb_release -s -c) echo "deb https://deb.nodesource.com/$VERSION $DISTRO main" | sudo tee /etc/apt/sources.list.d/nodesource.list sudo apt-get update sudo apt-get install -y nodejs echo "Node.js已安装" 功能用途:自动化安装指定版本的Node.js。 一键安装Redis #!/bin/bash sudo apt-get update sudo apt-get install -y redis-server sudo systemctl start redis sudo systemctl enable redis echo "Redis已安装并启动" 功能用途:自动化安装并启动Redis服务器。 一键安装MongoDB #!/bin/bash wget -qO - https://www.mongodb.org/static/pgp/server-4.4.asc | sudo apt-key add - echo "deb https://repo.mongodb.org/apt/ubuntu $(lsb_release -sc)/mongodb-org/4.4 multiverse" | sudo tee /etc/apt/sources.list.d/mongodb-org-4.4.list sudo apt-get update sudo apt-get install -y mongodb-org sudo systemctl start mongod sudo systemctl enable mongod echo "MongoDB已安装并启动" 功能用途:自动化安装并启动MongoDB数据库。 一键配置SSH无密码登录 #!/bin/bash read -p "请输入要配置的SSH密钥文件路径: " KEY_PATH ssh-copy-id -i $KEY_PATH user@remote_host # 替换user和remote_host为实际值 echo "SSH无密码登录已配置" 功能用途:将本地SSH密钥复制到远程主机,实现无密码登录。 一键安装Python虚拟环境 #!/bin/bash PYTHON_VERSION="3.8" # 可以根据需要更改版本 sudo apt-get update sudo apt-get install -y python3-$PYTHON_VERSION python3-venv echo "Python虚拟环境工具已安装" 功能用途:安装指定版本的Python及其虚拟环境工具。 一键压缩目录 #!/bin/bash read -p "请输入要压缩的目录路径: " DIR_PATH read -p "请输入压缩文件的名称: " ARCHIVE_NAME tar -czvf $ARCHIVE_NAME.tar.gz -C $(dirname $DIR_PATH) $(basename $DIR_PATH) echo "目录已压缩为 $ARCHIVE_NAME.tar.gz" 功能用途:压缩指定目录为tar.gz格式文件。 一键安装Java #!/bin/bash sudo apt-get update sudo apt-get install -y openjdk-11-jdk echo "Java已安装" 功能用途:安装OpenJDK 11。 一键检查磁盘空间 #!/bin/bash df -h | grep -Ev '^Filesystem|tmpfs|cdrom' 功能用途:检查并显示系统中各磁盘分区的使用情况,排除临时文件系统、光盘等。 这些脚本覆盖了Linux运维中的常见任务,包括服务器安装、数据库管理、系统更新、日志清理、开发工具安装等。请根据实际情况调整脚本中的参数和路径。

Linux运维常用一键脚本 一键安装Apache服务器 #!/bin/bash sudo apt-get update sudo apt-get install -y apache2 sudo systemctl start apache2 sudo systemctl enable apache2 echo "Apache服务器已安装并启动" 功能用途:自动化安装并启动Apache服务器。 一键安装MySQL数据库 #!/bin/bash sudo apt-get update sudo apt-get install -y mysql-server sudo mysql_secure_installation sudo systemctl start mysql sudo systemctl enable mysql echo "MySQL数据库已安装并启动" 功能用途:自动化安装MySQL数据库,并提示进行安全配置。 一键备份MySQL数据库 #!/bin/bash USER="your_mysql_user" PASSWORD="your_mysql_password" DB_NAME="your_database_name" BACKUP_DIR="/path/to/backup" DATE=$(date +"%Y-%m-%d") mysqldump -u $USER -p$PASSWORD $DB_NAME > $BACKUP_DIR/$DB_NAME-$DATE.sql echo "数据库已备份到 $BACKUP_DIR" 功能用途:备份指定的MySQL数据库到指定目录。 一键安装Nginx #!/bin/bash sudo apt-get update sudo apt-get install -y nginx sudo systemctl start nginx sudo systemctl enable nginx echo "Nginx服务器已安装并启动" 功能用途:自动化安装并启动Nginx服务器。 一键配置防火墙 #!/bin/bash sudo ufw allow 'Nginx Full' sudo ufw allow 'OpenSSH' sudo ufw enable sudo ufw status echo "防火墙已配置并启用" 功能用途:配置防火墙以允许Nginx和SSH服务。 一键更新系统 #!/bin/bash sudo apt-get update sudo apt-get upgrade -y sudo apt-get dist-upgrade -y sudo reboot echo "系统已更新并重启" 功能用途:更新系统软件包,并重启系统以应用更改。 一键安装Docker #!/bin/bash sudo apt-get update sudo apt-get install -y apt-transport-https ca-certificates curl software-properties-common curl -fsSL https://download.docker.com/linux/ubuntu/gpg | sudo apt-key add - sudo add-apt-repository "deb https://download.docker.com/linux/ubuntu $(lsb_release -cs) stable" sudo apt-get update sudo apt-get install -y docker-ce sudo systemctl start docker sudo systemctl enable docker sudo usermod -aG docker $USER echo "Docker已安装并启动,用户已添加到docker组" 功能用途:自动化安装Docker,并将当前用户添加到docker组。 一键清理系统日志 #!/bin/bash sudo find /var/log/ -type f -name "*.log" -exec truncate -s 0 {} \; echo "系统日志已清理" 功能用途:清空系统日志文件。 一键安装PHP #!/bin/bash sudo apt-get update sudo apt-get install -y php libapache2-mod-php php-mysql sudo systemctl restart apache2 echo "PHP已安装并配置为Apache模块" 功能用途:安装PHP及其Apache模块,以便在Apache服务器上运行PHP代码。 一键监控CPU和内存使用率 #!/bin/bash watch -n 1 'free -m && top -bn1 | grep "Cpu(s)"' 功能用途:实时监控CPU和内存使用率。 一键查找大文件 #!/bin/bash sudo find / -type f -size +100M -exec ls -lh {} \; | awk '{ print $9 ": " $5 }' 功能用途:查找系统中大于100MB的文件。 一键安装Git #!/bin/bash sudo apt-get update 一键安装Node.js #!/bin/bash VERSION="node_14.x" # 可以根据需要更改版本 DISTRO=$(lsb_release -s -c) echo "deb https://deb.nodesource.com/$VERSION $DISTRO main" | sudo tee /etc/apt/sources.list.d/nodesource.list sudo apt-get update sudo apt-get install -y nodejs echo "Node.js已安装" 功能用途:自动化安装指定版本的Node.js。 一键安装Redis #!/bin/bash sudo apt-get update sudo apt-get install -y redis-server sudo systemctl start redis sudo systemctl enable redis echo "Redis已安装并启动" 功能用途:自动化安装并启动Redis服务器。 一键安装MongoDB #!/bin/bash wget -qO - https://www.mongodb.org/static/pgp/server-4.4.asc | sudo apt-key add - echo "deb https://repo.mongodb.org/apt/ubuntu $(lsb_release -sc)/mongodb-org/4.4 multiverse" | sudo tee /etc/apt/sources.list.d/mongodb-org-4.4.list sudo apt-get update sudo apt-get install -y mongodb-org sudo systemctl start mongod sudo systemctl enable mongod echo "MongoDB已安装并启动" 功能用途:自动化安装并启动MongoDB数据库。 一键配置SSH无密码登录 #!/bin/bash read -p "请输入要配置的SSH密钥文件路径: " KEY_PATH ssh-copy-id -i $KEY_PATH user@remote_host # 替换user和remote_host为实际值 echo "SSH无密码登录已配置" 功能用途:将本地SSH密钥复制到远程主机,实现无密码登录。 一键安装Python虚拟环境 #!/bin/bash PYTHON_VERSION="3.8" # 可以根据需要更改版本 sudo apt-get update sudo apt-get install -y python3-$PYTHON_VERSION python3-venv echo "Python虚拟环境工具已安装" 功能用途:安装指定版本的Python及其虚拟环境工具。 一键压缩目录 #!/bin/bash read -p "请输入要压缩的目录路径: " DIR_PATH read -p "请输入压缩文件的名称: " ARCHIVE_NAME tar -czvf $ARCHIVE_NAME.tar.gz -C $(dirname $DIR_PATH) $(basename $DIR_PATH) echo "目录已压缩为 $ARCHIVE_NAME.tar.gz" 功能用途:压缩指定目录为tar.gz格式文件。 一键安装Java #!/bin/bash sudo apt-get update sudo apt-get install -y openjdk-11-jdk echo "Java已安装" 功能用途:安装OpenJDK 11。 一键检查磁盘空间 #!/bin/bash df -h | grep -Ev '^Filesystem|tmpfs|cdrom' 功能用途:检查并显示系统中各磁盘分区的使用情况,排除临时文件系统、光盘等。 这些脚本覆盖了Linux运维中的常见任务,包括服务器安装、数据库管理、系统更新、日志清理、开发工具安装等。请根据实际情况调整脚本中的参数和路径。 -

chatgpt-on-wechat 项目多种部署方式 chatgpt-on-wechat 项目提供了多种部署方式,以下是详细的部署步骤: 本地部署 1. 准备工作 系统要求:支持 Linux、MacOS、Windows 系统(可在Linux服务器上长期运行),同时需安装 Python。建议Python版本在 3.7.1 - 3.9.X 之间,推荐3.8版本,3.10及以上版本在 MacOS 可用,其他系统上不确定能否正常运行。 克隆项目代码: git clone https://github.com/zhayujie/chatgpt-on-wechat cd chatgpt-on-wechat/ 注:如遇到网络问题可选择国内镜像 https://gitee.com/zhayujie/chatgpt-on-wechat。 安装依赖: 核心依赖(必选):能够使用itchat创建机器人,并具有文字交流功能所需的最小依赖集合。 pip3 install -r requirements.txt 拓展依赖(可选,建议安装): pip3 install -r requirements-optional.txt 注意:如果某项依赖安装失败可注释掉对应的行再继续。 配置文件: 配置文件的模板在根目录的config-template.json中,需复制该模板创建最终生效的 config.json 文件: cp config-template.json config.json 然后在config.json中填入配置,以下是对默认配置的说明,可根据需要进行自定义修改(注意实际使用时请去掉注释,保证JSON格式的完整): { "model": "gpt-3.5-turbo", // 模型名称, 支持 gpt-3.5-turbo, gpt-4, gpt-4-turbo, wenxin, xunfei, glm-4, claude-3-haiku, moonshot "open_ai_api_key": "YOUR API KEY", // 如果使用openAI模型则填入上面创建的 OpenAI API KEY "open_ai_api_base": "https://api.openai.com/v1", // OpenAI接口代理地址 "proxy": "", // 代理客户端的ip和端口,国内环境开启代理的需要填写该项,如 "127.0.0.1:7890" "single_chat_prefix": , // 私聊时文本需要包含该前缀才能触发机器人回复 "single_chat_reply_prefix": " ", // 私聊时自动回复的前缀,用于区分真人 "group_chat_prefix": , // 群聊时包含该前缀则会触发机器人回复 "group_name_white_list": // 开启自动回复的群名称列表 } 2. 运行项目 使用nohup命令在后台运行程序: nohup python3 app.py & tail -f nohup.out # 在后台运行程序并通过日志输出二维码 扫码登录后程序即可运行于服务器后台,此时可通过 ctrl+c 关闭日志,不会影响后台程序的运行。使用 ps -ef | grep app.py | grep -v grep 命令可查看运行于后台的进程,如果想要重新启动程序可以先 kill 掉对应的进程。日志关闭后如果想要再次打开只需输入 tail -f nohup.out。此外,scripts 目录下有一键运行、关闭程序的脚本供使用。 多账号支持:将项目复制多份,分别启动程序,用不同账号扫码登录即可实现同时运行。 特殊指令:用户向机器人发送 #reset 即可清空该用户的上下文记忆。 Docker部署 前提条件:需要安装好 docker 及 docker-compose,安装成功的表现是执行 docker -v 和 docker-compose version (或 docker compose version) 可以查看到版本号,可前往 docker官网 进行下载。 步骤: 1.下载 docker-compose.yml 文件: wget https://open-1317903499.cos.ap-guangzhou.myqcloud.com/docker-compose.yml 下载完成后打开 docker-compose.yml 修改所需配置,如 OPEN_AI_API_KEY 和 GROUP_NAME_WHITE_LIST 等。 2.启动容器: 在 docker-compose.yml 所在目录下执行以下命令启动容器: sudo docker compose up -d 注意:如果 docker-compose 是 1.X 版本 则需要执行 sudo docker-compose up -d 来启动容器。 运行 sudo docker ps 能查看到 NAMES 为 chatgpt-on-wechat 的容器即表示运行成功。 3.查看容器运行日志: sudo docker logs -f chatgpt-on-wechat 扫描日志中的二维码即可完成登录。 4.插件使用: 如果需要在docker容器中修改插件配置,可通过挂载的方式完成,将 插件配置文件 重命名为 config.json,放置于 docker-compose.yml 相同目录下,并在 docker-compose.yml 中的 chatgpt-on-wechat 部分下添加 volumes 映射: volumes: - ./config.json:/app/plugins/config.json Railway部署 Railway 每月提供5刀和最多500小时的免费额度。 (07.11更新: 目前大部分账号已无法免费部署) 步骤: 进入 Railway。 点击 Deploy Now 按钮。 设置环境变量来重载程序运行的参数,例如open_ai_api_key, character_desc。 一键部署: https://railway.com/template/qApznZ?referralCode=RC3znh

chatgpt-on-wechat 项目多种部署方式 chatgpt-on-wechat 项目提供了多种部署方式,以下是详细的部署步骤: 本地部署 1. 准备工作 系统要求:支持 Linux、MacOS、Windows 系统(可在Linux服务器上长期运行),同时需安装 Python。建议Python版本在 3.7.1 - 3.9.X 之间,推荐3.8版本,3.10及以上版本在 MacOS 可用,其他系统上不确定能否正常运行。 克隆项目代码: git clone https://github.com/zhayujie/chatgpt-on-wechat cd chatgpt-on-wechat/ 注:如遇到网络问题可选择国内镜像 https://gitee.com/zhayujie/chatgpt-on-wechat。 安装依赖: 核心依赖(必选):能够使用itchat创建机器人,并具有文字交流功能所需的最小依赖集合。 pip3 install -r requirements.txt 拓展依赖(可选,建议安装): pip3 install -r requirements-optional.txt 注意:如果某项依赖安装失败可注释掉对应的行再继续。 配置文件: 配置文件的模板在根目录的config-template.json中,需复制该模板创建最终生效的 config.json 文件: cp config-template.json config.json 然后在config.json中填入配置,以下是对默认配置的说明,可根据需要进行自定义修改(注意实际使用时请去掉注释,保证JSON格式的完整): { "model": "gpt-3.5-turbo", // 模型名称, 支持 gpt-3.5-turbo, gpt-4, gpt-4-turbo, wenxin, xunfei, glm-4, claude-3-haiku, moonshot "open_ai_api_key": "YOUR API KEY", // 如果使用openAI模型则填入上面创建的 OpenAI API KEY "open_ai_api_base": "https://api.openai.com/v1", // OpenAI接口代理地址 "proxy": "", // 代理客户端的ip和端口,国内环境开启代理的需要填写该项,如 "127.0.0.1:7890" "single_chat_prefix": , // 私聊时文本需要包含该前缀才能触发机器人回复 "single_chat_reply_prefix": " ", // 私聊时自动回复的前缀,用于区分真人 "group_chat_prefix": , // 群聊时包含该前缀则会触发机器人回复 "group_name_white_list": // 开启自动回复的群名称列表 } 2. 运行项目 使用nohup命令在后台运行程序: nohup python3 app.py & tail -f nohup.out # 在后台运行程序并通过日志输出二维码 扫码登录后程序即可运行于服务器后台,此时可通过 ctrl+c 关闭日志,不会影响后台程序的运行。使用 ps -ef | grep app.py | grep -v grep 命令可查看运行于后台的进程,如果想要重新启动程序可以先 kill 掉对应的进程。日志关闭后如果想要再次打开只需输入 tail -f nohup.out。此外,scripts 目录下有一键运行、关闭程序的脚本供使用。 多账号支持:将项目复制多份,分别启动程序,用不同账号扫码登录即可实现同时运行。 特殊指令:用户向机器人发送 #reset 即可清空该用户的上下文记忆。 Docker部署 前提条件:需要安装好 docker 及 docker-compose,安装成功的表现是执行 docker -v 和 docker-compose version (或 docker compose version) 可以查看到版本号,可前往 docker官网 进行下载。 步骤: 1.下载 docker-compose.yml 文件: wget https://open-1317903499.cos.ap-guangzhou.myqcloud.com/docker-compose.yml 下载完成后打开 docker-compose.yml 修改所需配置,如 OPEN_AI_API_KEY 和 GROUP_NAME_WHITE_LIST 等。 2.启动容器: 在 docker-compose.yml 所在目录下执行以下命令启动容器: sudo docker compose up -d 注意:如果 docker-compose 是 1.X 版本 则需要执行 sudo docker-compose up -d 来启动容器。 运行 sudo docker ps 能查看到 NAMES 为 chatgpt-on-wechat 的容器即表示运行成功。 3.查看容器运行日志: sudo docker logs -f chatgpt-on-wechat 扫描日志中的二维码即可完成登录。 4.插件使用: 如果需要在docker容器中修改插件配置,可通过挂载的方式完成,将 插件配置文件 重命名为 config.json,放置于 docker-compose.yml 相同目录下,并在 docker-compose.yml 中的 chatgpt-on-wechat 部分下添加 volumes 映射: volumes: - ./config.json:/app/plugins/config.json Railway部署 Railway 每月提供5刀和最多500小时的免费额度。 (07.11更新: 目前大部分账号已无法免费部署) 步骤: 进入 Railway。 点击 Deploy Now 按钮。 设置环境变量来重载程序运行的参数,例如open_ai_api_key, character_desc。 一键部署: https://railway.com/template/qApznZ?referralCode=RC3znh -

DeepSeek 满血版本地化傻瓜式可视化部署方案 DeepSeek满血版本地化傻瓜式可视化部署方案 一、方案背景与目标 背景 DeepSeek作为先进的大语言模型,具备强大的语言理解和生成能力。将其进行本地化部署,能够在保障数据安全和隐私的同时,满足特定场景下的高效使用需求。本方案旨在为非专业技术人员提供一种简单、直观的方式,实现DeepSeek满血版的本地部署与使用。 目标 通过傻瓜式、可视化的部署流程,让用户能够轻松在本地环境搭建DeepSeek模型,并通过可视化界面与之交互,完成文本生成、问答等任务。 二、准备工作 硬件要求 硬件组件 推荐配置 说明 CPU Intel Core i7 及以上或 AMD Ryzen 7 及以上 多核心处理器可加速模型推理过程 内存 16GB 及以上 足够的内存可避免因内存不足导致的程序崩溃 硬盘 512GB 及以上 SSD 快速的读写速度可加快模型文件加载和数据处理 GPU NVIDIA GeForce RTX 3060 及以上 支持 CUDA 加速,显著提升模型运行效率 网络 稳定的宽带网络 用于下载软件、代码和模型文件 软件准备 Anaconda Anaconda 是一个开源的 Python 发行版本,包含了 Python、众多科学计算库以及包管理工具 conda。 下载:访问 Anaconda 官网(https://www.anaconda.com/download ),根据自己的操作系统(Windows、Mac OS、Linux)选择对应的安装包进行下载。 安装:运行下载好的安装包,按照安装向导的提示进行操作。在安装过程中,建议勾选“Add Anaconda to my PATH environment variable”选项,以便在命令行中可以直接使用 conda 命令。 Git 客户端 Git 是一种分布式版本控制系统,用于管理代码的版本和协作开发。 下载:访问 Git 官网(https://git-scm.com/downloads ),选择适合自己操作系统的版本进行下载。 安装:运行下载好的安装包,按照默认设置完成安装。安装完成后,在命令行中输入 git --version 验证安装是否成功。 NVIDIA 驱动 如果你的计算机配备了 NVIDIA GPU,需要安装相应的驱动程序以支持 CUDA 加速。 下载:访问 NVIDIA 官网(https://www.nvidia.com/Download/index.aspx ),根据自己的 GPU 型号、操作系统和 CUDA 版本选择合适的驱动程序进行下载。 安装:运行下载好的驱动程序安装包,按照安装向导的提示完成安装。安装完成后,在命令行中输入 nvidia-smi 验证驱动是否安装成功。 CUDA 和 cuDNN(可选但推荐) CUDA 是 NVIDIA 推出的并行计算平台和编程模型,cuDNN 是 NVIDIA 提供的深度神经网络库,它们可以显著加速基于 GPU 的深度学习模型训练和推理。 CUDA 安装:访问 NVIDIA CUDA 官网(https://developer.nvidia.com/cuda-downloads ),选择适合自己操作系统的 CUDA 版本进行下载和安装。安装过程中按照提示进行操作,注意记录安装路径。 cuDNN 安装:访问 NVIDIA cuDNN 官网(https://developer.nvidia.com/cudnn ),注册并登录后下载与 CUDA 版本兼容的 cuDNN 库。将下载的压缩包解压后,将其中的文件复制到 CUDA 安装目录对应的文件夹中。 三、部署步骤 1. 创建并激活 Anaconda 环境 打开 Anaconda Prompt(Windows)或终端(Mac OS、Linux)。 输入以下命令创建一个名为 deepseek_env 的 Python 3.8 环境: conda create -n deepseek_env python=3.8 输入以下命令激活该环境: conda activate deepseek_env 2. 获取 DeepSeek 代码 在激活的 Anaconda 环境下,打开 Git Bash(Windows)或终端(Mac OS、Linux)。 输入以下命令将 DeepSeek 代码克隆到本地: git clone <DeepSeek代码仓库地址> 请将 <DeepSeek代码仓库地址> 替换为 DeepSeek 官方提供的真实代码仓库链接。如果代码仓库是私有的,可能需要输入用户名和密码进行身份验证。 3. 安装依赖包 进入克隆下来的 DeepSeek 代码目录,例如: cd deepseek 输入以下命令安装运行所需的依赖包: pip install -r requirements.txt 安装过程可能会持续一段时间,具体时间取决于网络速度和依赖包的数量。如果在安装过程中遇到问题,可以尝试使用国内镜像源加速下载,例如: pip install -r requirements.txt -i https://pypi.tuna.tsinghua.edu.cn/simple 4. 下载模型文件 从 DeepSeek 官方指定的模型下载地址获取满血版模型文件。这些文件可能包含模型权重、配置文件等。 创建一个 models 文件夹用于存放模型文件: mkdir models 将下载好的模型文件解压到 models 文件夹中。确保文件路径与代码中配置的模型路径一致。 5. 配置环境变量(可选) 如果安装了 CUDA 和 cuDNN,需要配置相应的环境变量,以便程序能够正确找到这些库。 在 Windows 系统中,右键点击“此电脑”,选择“属性” -> “高级系统设置” -> “环境变量”,在系统变量中添加以下变量: CUDA_PATH:指向 CUDA 安装目录,例如 C:\Program Files\NVIDIA GPU Computing Toolkit\CUDA\v11.7 PATH:在原有的 PATH 变量中添加 %CUDA_PATH%\bin 和 %CUDA_PATH%\libnvvp 在 Linux 或 Mac OS 系统中,编辑 ~/.bashrc 或 ~/.zshrc 文件,添加以下内容: export PATH=/usr/local/cuda/bin:$PATH export LD_LIBRARY_PATH=/usr/local/cuda/lib64:$LD_LIBRARY_PATH 然后执行 source ~/.bashrc 或 source ~/.zshrc 使配置生效。 6. 启动可视化界面 在代码目录下,输入以下命令启动可视化界面: python app.py 启动成功后,会在命令行中显示一个本地链接,如 http://127.0.0.1:7860。 打开浏览器,输入该链接,即可看到 DeepSeek 的可视化界面。 四、测试与优化 简单测试 在可视化界面中输入一些测试文本,例如:“介绍一下人工智能”,然后点击生成按钮。 观察生成结果是否符合预期,包括文本的逻辑性、语法正确性和相关性。 如果生成结果出现错误或不符合要求,可以尝试调整输入文本的表述方式或修改模型的参数设置。 性能优化 调整模型参数 在可视化界面的设置选项中,通常可以找到一些模型参数,如生成的最大长度、采样温度等。 最大长度:适当降低最大长度可以减少生成时间,但可能会导致生成的文本不够完整。 采样温度:降低采样温度可以使生成的文本更加确定和保守,提高采样温度可以使生成的文本更加多样化和随机。 资源管理 定期清理缓存文件,释放硬盘空间。可在代码目录下找到缓存文件夹进行清理。 关闭不必要的后台程序,以确保计算机有足够的资源用于运行 DeepSeek 模型。 硬件升级 如果在使用过程中发现性能仍然无法满足需求,可以考虑升级硬件,如增加内存、更换更强大的 GPU 等。 五、常见问题及解决方法 依赖包安装失败 问题描述:在执行 pip install -r requirements.txt 时,部分依赖包安装失败。 解决方法: 检查网络连接是否稳定,尝试使用国内镜像源加速下载。 查看错误信息,可能是某些依赖包版本不兼容。可以尝试手动安装指定版本的依赖包,例如 pip install package_name==version_number。 模型文件加载失败 问题描述:启动可视化界面时,提示模型文件加载失败。 解决方法: 检查模型文件是否完整下载并解压到正确的目录。 确保代码中配置的模型路径与实际模型文件路径一致。 GPU 加速未生效 问题描述:计算机配备了 NVIDIA GPU,但在运行过程中未使用 GPU 加速。 解决方法: 检查 NVIDIA 驱动、CUDA 和 cuDNN 是否正确安装并配置。 在代码中添加相应的 GPU 配置代码,例如: import torch device = torch.device("cuda" if torch.cuda.is_available() else "cpu") model.to(device) 六、总结 通过以上步骤,你可以轻松地在本地环境实现 DeepSeek 满血版的傻瓜式、可视化部署。在部署过程中,按照准备工作的要求确保硬件和软件环境的正确性,严格遵循部署步骤进行操作。遇到问题时,参考常见问题及解决方法进行排查和修复。

DeepSeek 满血版本地化傻瓜式可视化部署方案 DeepSeek满血版本地化傻瓜式可视化部署方案 一、方案背景与目标 背景 DeepSeek作为先进的大语言模型,具备强大的语言理解和生成能力。将其进行本地化部署,能够在保障数据安全和隐私的同时,满足特定场景下的高效使用需求。本方案旨在为非专业技术人员提供一种简单、直观的方式,实现DeepSeek满血版的本地部署与使用。 目标 通过傻瓜式、可视化的部署流程,让用户能够轻松在本地环境搭建DeepSeek模型,并通过可视化界面与之交互,完成文本生成、问答等任务。 二、准备工作 硬件要求 硬件组件 推荐配置 说明 CPU Intel Core i7 及以上或 AMD Ryzen 7 及以上 多核心处理器可加速模型推理过程 内存 16GB 及以上 足够的内存可避免因内存不足导致的程序崩溃 硬盘 512GB 及以上 SSD 快速的读写速度可加快模型文件加载和数据处理 GPU NVIDIA GeForce RTX 3060 及以上 支持 CUDA 加速,显著提升模型运行效率 网络 稳定的宽带网络 用于下载软件、代码和模型文件 软件准备 Anaconda Anaconda 是一个开源的 Python 发行版本,包含了 Python、众多科学计算库以及包管理工具 conda。 下载:访问 Anaconda 官网(https://www.anaconda.com/download ),根据自己的操作系统(Windows、Mac OS、Linux)选择对应的安装包进行下载。 安装:运行下载好的安装包,按照安装向导的提示进行操作。在安装过程中,建议勾选“Add Anaconda to my PATH environment variable”选项,以便在命令行中可以直接使用 conda 命令。 Git 客户端 Git 是一种分布式版本控制系统,用于管理代码的版本和协作开发。 下载:访问 Git 官网(https://git-scm.com/downloads ),选择适合自己操作系统的版本进行下载。 安装:运行下载好的安装包,按照默认设置完成安装。安装完成后,在命令行中输入 git --version 验证安装是否成功。 NVIDIA 驱动 如果你的计算机配备了 NVIDIA GPU,需要安装相应的驱动程序以支持 CUDA 加速。 下载:访问 NVIDIA 官网(https://www.nvidia.com/Download/index.aspx ),根据自己的 GPU 型号、操作系统和 CUDA 版本选择合适的驱动程序进行下载。 安装:运行下载好的驱动程序安装包,按照安装向导的提示完成安装。安装完成后,在命令行中输入 nvidia-smi 验证驱动是否安装成功。 CUDA 和 cuDNN(可选但推荐) CUDA 是 NVIDIA 推出的并行计算平台和编程模型,cuDNN 是 NVIDIA 提供的深度神经网络库,它们可以显著加速基于 GPU 的深度学习模型训练和推理。 CUDA 安装:访问 NVIDIA CUDA 官网(https://developer.nvidia.com/cuda-downloads ),选择适合自己操作系统的 CUDA 版本进行下载和安装。安装过程中按照提示进行操作,注意记录安装路径。 cuDNN 安装:访问 NVIDIA cuDNN 官网(https://developer.nvidia.com/cudnn ),注册并登录后下载与 CUDA 版本兼容的 cuDNN 库。将下载的压缩包解压后,将其中的文件复制到 CUDA 安装目录对应的文件夹中。 三、部署步骤 1. 创建并激活 Anaconda 环境 打开 Anaconda Prompt(Windows)或终端(Mac OS、Linux)。 输入以下命令创建一个名为 deepseek_env 的 Python 3.8 环境: conda create -n deepseek_env python=3.8 输入以下命令激活该环境: conda activate deepseek_env 2. 获取 DeepSeek 代码 在激活的 Anaconda 环境下,打开 Git Bash(Windows)或终端(Mac OS、Linux)。 输入以下命令将 DeepSeek 代码克隆到本地: git clone <DeepSeek代码仓库地址> 请将 <DeepSeek代码仓库地址> 替换为 DeepSeek 官方提供的真实代码仓库链接。如果代码仓库是私有的,可能需要输入用户名和密码进行身份验证。 3. 安装依赖包 进入克隆下来的 DeepSeek 代码目录,例如: cd deepseek 输入以下命令安装运行所需的依赖包: pip install -r requirements.txt 安装过程可能会持续一段时间,具体时间取决于网络速度和依赖包的数量。如果在安装过程中遇到问题,可以尝试使用国内镜像源加速下载,例如: pip install -r requirements.txt -i https://pypi.tuna.tsinghua.edu.cn/simple 4. 下载模型文件 从 DeepSeek 官方指定的模型下载地址获取满血版模型文件。这些文件可能包含模型权重、配置文件等。 创建一个 models 文件夹用于存放模型文件: mkdir models 将下载好的模型文件解压到 models 文件夹中。确保文件路径与代码中配置的模型路径一致。 5. 配置环境变量(可选) 如果安装了 CUDA 和 cuDNN,需要配置相应的环境变量,以便程序能够正确找到这些库。 在 Windows 系统中,右键点击“此电脑”,选择“属性” -> “高级系统设置” -> “环境变量”,在系统变量中添加以下变量: CUDA_PATH:指向 CUDA 安装目录,例如 C:\Program Files\NVIDIA GPU Computing Toolkit\CUDA\v11.7 PATH:在原有的 PATH 变量中添加 %CUDA_PATH%\bin 和 %CUDA_PATH%\libnvvp 在 Linux 或 Mac OS 系统中,编辑 ~/.bashrc 或 ~/.zshrc 文件,添加以下内容: export PATH=/usr/local/cuda/bin:$PATH export LD_LIBRARY_PATH=/usr/local/cuda/lib64:$LD_LIBRARY_PATH 然后执行 source ~/.bashrc 或 source ~/.zshrc 使配置生效。 6. 启动可视化界面 在代码目录下,输入以下命令启动可视化界面: python app.py 启动成功后,会在命令行中显示一个本地链接,如 http://127.0.0.1:7860。 打开浏览器,输入该链接,即可看到 DeepSeek 的可视化界面。 四、测试与优化 简单测试 在可视化界面中输入一些测试文本,例如:“介绍一下人工智能”,然后点击生成按钮。 观察生成结果是否符合预期,包括文本的逻辑性、语法正确性和相关性。 如果生成结果出现错误或不符合要求,可以尝试调整输入文本的表述方式或修改模型的参数设置。 性能优化 调整模型参数 在可视化界面的设置选项中,通常可以找到一些模型参数,如生成的最大长度、采样温度等。 最大长度:适当降低最大长度可以减少生成时间,但可能会导致生成的文本不够完整。 采样温度:降低采样温度可以使生成的文本更加确定和保守,提高采样温度可以使生成的文本更加多样化和随机。 资源管理 定期清理缓存文件,释放硬盘空间。可在代码目录下找到缓存文件夹进行清理。 关闭不必要的后台程序,以确保计算机有足够的资源用于运行 DeepSeek 模型。 硬件升级 如果在使用过程中发现性能仍然无法满足需求,可以考虑升级硬件,如增加内存、更换更强大的 GPU 等。 五、常见问题及解决方法 依赖包安装失败 问题描述:在执行 pip install -r requirements.txt 时,部分依赖包安装失败。 解决方法: 检查网络连接是否稳定,尝试使用国内镜像源加速下载。 查看错误信息,可能是某些依赖包版本不兼容。可以尝试手动安装指定版本的依赖包,例如 pip install package_name==version_number。 模型文件加载失败 问题描述:启动可视化界面时,提示模型文件加载失败。 解决方法: 检查模型文件是否完整下载并解压到正确的目录。 确保代码中配置的模型路径与实际模型文件路径一致。 GPU 加速未生效 问题描述:计算机配备了 NVIDIA GPU,但在运行过程中未使用 GPU 加速。 解决方法: 检查 NVIDIA 驱动、CUDA 和 cuDNN 是否正确安装并配置。 在代码中添加相应的 GPU 配置代码,例如: import torch device = torch.device("cuda" if torch.cuda.is_available() else "cpu") model.to(device) 六、总结 通过以上步骤,你可以轻松地在本地环境实现 DeepSeek 满血版的傻瓜式、可视化部署。在部署过程中,按照准备工作的要求确保硬件和软件环境的正确性,严格遵循部署步骤进行操作。遇到问题时,参考常见问题及解决方法进行排查和修复。 -

DeepSeek 本地部署AI对话网页版 DeepSeek 本地部署AI对话网页版 安装指南 安装 ollama 访问 https://www.ollama.com/ ,下载安装包,安装 ollama 安装deepseek-r1:7b模型 访问 https://www.ollama.com/library/deepseek-r1 ,在命令行执行如下命令,安装deepseek-r1:7b模型 ollama run deepseek-r1:14b 下载本项目代码,DeepSeek 本地部署AI对话网页版 下载本项目代码。 git clone https://gitee.com/deepseeklocal/deepseek-local.git 安装nodejs 访问 https://nodejs.org/zh-cn/download ,下载安装包,安装nodejs 进入deepseek-local目录,运行如下命令,启动nodejs服务 npm install node app.js 访问 http://localhost:8888 ,即可看到DeepSeek 本地部署AI对话网页版 管理员默认登录账号: admin 密码:111111 点击“聊天”,即可看到DeepSeek 本地部署AI对话网页版

DeepSeek 本地部署AI对话网页版 DeepSeek 本地部署AI对话网页版 安装指南 安装 ollama 访问 https://www.ollama.com/ ,下载安装包,安装 ollama 安装deepseek-r1:7b模型 访问 https://www.ollama.com/library/deepseek-r1 ,在命令行执行如下命令,安装deepseek-r1:7b模型 ollama run deepseek-r1:14b 下载本项目代码,DeepSeek 本地部署AI对话网页版 下载本项目代码。 git clone https://gitee.com/deepseeklocal/deepseek-local.git 安装nodejs 访问 https://nodejs.org/zh-cn/download ,下载安装包,安装nodejs 进入deepseek-local目录,运行如下命令,启动nodejs服务 npm install node app.js 访问 http://localhost:8888 ,即可看到DeepSeek 本地部署AI对话网页版 管理员默认登录账号: admin 密码:111111 点击“聊天”,即可看到DeepSeek 本地部署AI对话网页版 -

如何将 Chatbox 连接到远程 Ollama 服务 现在有越来越多的开源模型,可以让你在自己的电脑或服务器上运行。使用本地模型有许多优势: 完全离线运行,保护隐私数据安全 无需支付在线 API 费用 完全离线,服务稳定,无网络延迟 可以自由调整和定制模型参数 Chatbox 可以很好地连接到 Ollama 服务,让你在使用本地模型时可以获取 Chatbox 提供的更多强大功能,比如 Artifact Preview、文件解析、会话话题管理、Prompt 管理等。 (注意:运行本地模型对你的电脑配置有一定要求,包括内存、GPU 等。如果出现卡顿,请尝试降低模型参数。) 安装 Ollama Ollama 是一个开源的本地模型运行工具,可以方便地下载和运行各种开源模型,比如 Llama、Qwen、DeepSeek 等。这个工具支持 Windows、MacOS、Linux 等操作系统。 Ollama 下载地址 https://ollama.com/ 下载并运行本地模型 下载并安装 Ollama 后,请打开命令行终端,输入命令下载并运行本地模型。你可以在这里查看到所有 ollama 支持的模型列表:Ollama 模型列表。 举例1:下载并运行 llama3.2 模型 ollama run llama3.2 举例2:下载并运行 deepseek-r1:8b 模型(注意:Ollama 上的 DeepSeek R1 模型实际上是蒸馏模型) ollama run deepseek-r1:8b 在 Chatbox 中连接本地 Ollama 服务 在 Chatbox 中打开设置,在模型提供方中选择 Ollama,即可在模型下拉框中看见你运行的本地模型。 点击保存,即可正常聊天使用。 在 Chatbox 中连接远程 Ollama 服务 除了可以轻松连接本地 Ollama 服务,Chatbox 也支持连接到运行在其他机器上的远程 Ollama 服务。 例如,你可以在家中的电脑上运行 Ollama 服务,并在手机或其他电脑上使用 Chatbox 客户端连接到这个服务。 你需要确保远程 Ollama 服务正确配置并暴露在当前网络中,以便 Chatbox 可以访问。默认情况下,需要对远程 Ollama 服务进行简单的配置。 如何配置远程 Ollama 服务? 默认情况下,Ollama 服务仅在本地运行,不对外提供服务。要使 Ollama 服务能够对外提供服务,你需要设置以下两个环境变量: OLLAMA_HOST=0.0.0.0 OLLAMA_ORIGINS=* 在 MacOS 上配置 1、打开命令行终端,输入以下命令: launchctl setenv OLLAMA_HOST "0.0.0.0" launchctl setenv OLLAMA_ORIGINS "*" 2、重启 Ollama 应用,使配置生效。 在 Windows 上配置 在 Windows 上,Ollama 会继承你的用户和系统环境变量。 1、通过任务栏退出 Ollama。 2、打开设置(Windows 11)或控制面板(Windows 10),并搜索“环境变量”。 3、点击编辑你账户的环境变量。 为你的用户账户编辑或创建新的变量 OLLAMA_HOST,值为 0.0.0.0; 为你的用户账户编辑或创建新的变量 OLLAMA_ORIGINS,值为 *。 4、点击确定/应用以保存设置。 5、从 Windows 开始菜单启动 Ollama 应用程序。 在 Linux 上配置 如果 Ollama 作为 systemd 服务运行,应使用 systemctl 设置环境变量: 1、调用 systemctl edit ollama.service 编辑 systemd 服务配置。这将打开一个编辑器。 2、在 部分下为每个环境变量添加一行 Environment: Environment="OLLAMA_HOST=0.0.0.0" Environment="OLLAMA_ORIGINS=*" 3、保存并退出。 4、重新加载 systemd 并重启 Ollama: systemctl daemon-reload systemctl restart ollama 服务 IP 地址 配置后,Ollama 服务将能在当前网络(如家庭 Wifi)中提供服务。你可以使用其他设备上的 Chatbox 客户端连接到此服务。 Ollama 服务的 IP 地址是你电脑在当前网络中的地址,通常形式如下: 192.168.XX.XX 在 Chatbox 中,将 API Host 设置为: http://192.168.XX.XX:11434 注意事项 可能需要在防火墙中允许 Ollama 服务的端口(默认为 11434),具体取决于你的操作系统和网络环境。 为避免安全风险,请不要将 Ollama 服务暴露在公共网络中。家庭 Wifi 网络是一个相对安全的环境。

如何将 Chatbox 连接到远程 Ollama 服务 现在有越来越多的开源模型,可以让你在自己的电脑或服务器上运行。使用本地模型有许多优势: 完全离线运行,保护隐私数据安全 无需支付在线 API 费用 完全离线,服务稳定,无网络延迟 可以自由调整和定制模型参数 Chatbox 可以很好地连接到 Ollama 服务,让你在使用本地模型时可以获取 Chatbox 提供的更多强大功能,比如 Artifact Preview、文件解析、会话话题管理、Prompt 管理等。 (注意:运行本地模型对你的电脑配置有一定要求,包括内存、GPU 等。如果出现卡顿,请尝试降低模型参数。) 安装 Ollama Ollama 是一个开源的本地模型运行工具,可以方便地下载和运行各种开源模型,比如 Llama、Qwen、DeepSeek 等。这个工具支持 Windows、MacOS、Linux 等操作系统。 Ollama 下载地址 https://ollama.com/ 下载并运行本地模型 下载并安装 Ollama 后,请打开命令行终端,输入命令下载并运行本地模型。你可以在这里查看到所有 ollama 支持的模型列表:Ollama 模型列表。 举例1:下载并运行 llama3.2 模型 ollama run llama3.2 举例2:下载并运行 deepseek-r1:8b 模型(注意:Ollama 上的 DeepSeek R1 模型实际上是蒸馏模型) ollama run deepseek-r1:8b 在 Chatbox 中连接本地 Ollama 服务 在 Chatbox 中打开设置,在模型提供方中选择 Ollama,即可在模型下拉框中看见你运行的本地模型。 点击保存,即可正常聊天使用。 在 Chatbox 中连接远程 Ollama 服务 除了可以轻松连接本地 Ollama 服务,Chatbox 也支持连接到运行在其他机器上的远程 Ollama 服务。 例如,你可以在家中的电脑上运行 Ollama 服务,并在手机或其他电脑上使用 Chatbox 客户端连接到这个服务。 你需要确保远程 Ollama 服务正确配置并暴露在当前网络中,以便 Chatbox 可以访问。默认情况下,需要对远程 Ollama 服务进行简单的配置。 如何配置远程 Ollama 服务? 默认情况下,Ollama 服务仅在本地运行,不对外提供服务。要使 Ollama 服务能够对外提供服务,你需要设置以下两个环境变量: OLLAMA_HOST=0.0.0.0 OLLAMA_ORIGINS=* 在 MacOS 上配置 1、打开命令行终端,输入以下命令: launchctl setenv OLLAMA_HOST "0.0.0.0" launchctl setenv OLLAMA_ORIGINS "*" 2、重启 Ollama 应用,使配置生效。 在 Windows 上配置 在 Windows 上,Ollama 会继承你的用户和系统环境变量。 1、通过任务栏退出 Ollama。 2、打开设置(Windows 11)或控制面板(Windows 10),并搜索“环境变量”。 3、点击编辑你账户的环境变量。 为你的用户账户编辑或创建新的变量 OLLAMA_HOST,值为 0.0.0.0; 为你的用户账户编辑或创建新的变量 OLLAMA_ORIGINS,值为 *。 4、点击确定/应用以保存设置。 5、从 Windows 开始菜单启动 Ollama 应用程序。 在 Linux 上配置 如果 Ollama 作为 systemd 服务运行,应使用 systemctl 设置环境变量: 1、调用 systemctl edit ollama.service 编辑 systemd 服务配置。这将打开一个编辑器。 2、在 部分下为每个环境变量添加一行 Environment: Environment="OLLAMA_HOST=0.0.0.0" Environment="OLLAMA_ORIGINS=*" 3、保存并退出。 4、重新加载 systemd 并重启 Ollama: systemctl daemon-reload systemctl restart ollama 服务 IP 地址 配置后,Ollama 服务将能在当前网络(如家庭 Wifi)中提供服务。你可以使用其他设备上的 Chatbox 客户端连接到此服务。 Ollama 服务的 IP 地址是你电脑在当前网络中的地址,通常形式如下: 192.168.XX.XX 在 Chatbox 中,将 API Host 设置为: http://192.168.XX.XX:11434 注意事项 可能需要在防火墙中允许 Ollama 服务的端口(默认为 11434),具体取决于你的操作系统和网络环境。 为避免安全风险,请不要将 Ollama 服务暴露在公共网络中。家庭 Wifi 网络是一个相对安全的环境。 -

常用思科、华为、H3C交换机巡检命令 一、思科交换机巡检命令 1、show interface stats:查看交换机所有接口当前接口流量 2、show running-config:查看当前设备配置 3、show version:查看IOS版本信息及设备正常运行时间 4、show clock:查看设备时钟信息 5、show vtp status:查看交换机vtp配置模式 6、show vtp password:查看交换机vtp配置口令 7、show env all:查看设备温度,电源和风扇运转参数及是否报警 8、show inventory:调取设备内部板卡出厂模块型号及序列号 9、show spanning-tree root:查看交换机生成树根位置 10、show cdp neighbors:查看邻接cisco设备基本信息 11、show cdp neighbors detail:查看邻接cisco设备详细信息 12、show interface status:查看交换机接口状态是否存在errordisable接口disable接口 13、show interface summary:查看交换机所有接口当前接口流量 14、show interface |ierrors|FastEthernet|GigabitEthernet:查看接口是否存在大量input或output errors包错误 15、show processes cpu:查看设备cpu负载 16、show processes mem:查看设备mem负载 17、show access-list:查看访问控制列表配置及匹配数据包数量 18、show logging:查看本机内部日志记录情况 19、show ip route:查看路由表 20、show firewall:检查防火墙的工作模式 21、show conn count:检查防火墙并发数 22、show xlate count:检查防火墙nat工作状态 二、华为/H3C交换机常用巡检命令 system-view #进入系统视图 user-interface vty 0 4 #vty就是用telnet/ssh远程进入交换机的界面(虚拟界面) 2、硬件状态、IOS版本信息检查 display clock #系统时间 display version #查看版本信息,最近一次重新启动的时间 display enviroment #设备温度 display device #单板运行状态 display device manuinfor #查看设备序列号 display power #查看电源状况 display fan #查看风扇状况 display cpu-usage #查看cpu最近5S、1m、5m占用率 display cpu history #查看cpu使用记录 display cpu-usage task #查看CPU利用率 display memory #查看内存大小和占用率 display logbuffer #日志缓冲区 dir flash: #查看flash dis boot-loader #显示软件映像文件 display arp #查看arp表(目的IP与目的MAC的映射关系) display mac-address #查看mac地址表(二层转发通过mac地址表) display ntp status #ntp状态信息 reset counters interface #清除接口统计信息,方便下次巡检查看接口错误包是否增加 display elabel #路由器设备命令—查看电子标签信息(华为)改用display device manuinfo display ndp #路由器设备命令—华三V5版本支持,现在改用display lldp neighbor-information display diagnostic-information #故障信息收集 2、系统运行配置状态检查 display interface #接口流量、链路状态 dis current-configuration inter #地址分配 dis current-configuration |include ospf #路由扩散 display ip routing-table #路由信息 display ip interface #显示 vlan 端口统计数据 display saved-configuration #保存配置文件 display logbuffer #日志信息 display port trunk #查看参与 trunk 的端口 3、STP 信息检查 display stp root #查看 stp 根情况 display stp brief #查看 stp 简单信息 display stp abnormal-port #查看是否有非正常端口 display stp region-configuration #生成树区域配置 display lldp neighbor-information #查看链路层邻居发现协议(邻居信息) display tcp status #路由器设备命令—tcp统计数据 display tcp statistics #交换机设备命令—tcp统计数据 4、 vrrp 和端口聚合检查 display vrrp #查看虚拟路由冗余协议 display vrrp statistics #查看主备用状态 display link-aggregation summary #查看链路聚合组的情况

常用思科、华为、H3C交换机巡检命令 一、思科交换机巡检命令 1、show interface stats:查看交换机所有接口当前接口流量 2、show running-config:查看当前设备配置 3、show version:查看IOS版本信息及设备正常运行时间 4、show clock:查看设备时钟信息 5、show vtp status:查看交换机vtp配置模式 6、show vtp password:查看交换机vtp配置口令 7、show env all:查看设备温度,电源和风扇运转参数及是否报警 8、show inventory:调取设备内部板卡出厂模块型号及序列号 9、show spanning-tree root:查看交换机生成树根位置 10、show cdp neighbors:查看邻接cisco设备基本信息 11、show cdp neighbors detail:查看邻接cisco设备详细信息 12、show interface status:查看交换机接口状态是否存在errordisable接口disable接口 13、show interface summary:查看交换机所有接口当前接口流量 14、show interface |ierrors|FastEthernet|GigabitEthernet:查看接口是否存在大量input或output errors包错误 15、show processes cpu:查看设备cpu负载 16、show processes mem:查看设备mem负载 17、show access-list:查看访问控制列表配置及匹配数据包数量 18、show logging:查看本机内部日志记录情况 19、show ip route:查看路由表 20、show firewall:检查防火墙的工作模式 21、show conn count:检查防火墙并发数 22、show xlate count:检查防火墙nat工作状态 二、华为/H3C交换机常用巡检命令 system-view #进入系统视图 user-interface vty 0 4 #vty就是用telnet/ssh远程进入交换机的界面(虚拟界面) 2、硬件状态、IOS版本信息检查 display clock #系统时间 display version #查看版本信息,最近一次重新启动的时间 display enviroment #设备温度 display device #单板运行状态 display device manuinfor #查看设备序列号 display power #查看电源状况 display fan #查看风扇状况 display cpu-usage #查看cpu最近5S、1m、5m占用率 display cpu history #查看cpu使用记录 display cpu-usage task #查看CPU利用率 display memory #查看内存大小和占用率 display logbuffer #日志缓冲区 dir flash: #查看flash dis boot-loader #显示软件映像文件 display arp #查看arp表(目的IP与目的MAC的映射关系) display mac-address #查看mac地址表(二层转发通过mac地址表) display ntp status #ntp状态信息 reset counters interface #清除接口统计信息,方便下次巡检查看接口错误包是否增加 display elabel #路由器设备命令—查看电子标签信息(华为)改用display device manuinfo display ndp #路由器设备命令—华三V5版本支持,现在改用display lldp neighbor-information display diagnostic-information #故障信息收集 2、系统运行配置状态检查 display interface #接口流量、链路状态 dis current-configuration inter #地址分配 dis current-configuration |include ospf #路由扩散 display ip routing-table #路由信息 display ip interface #显示 vlan 端口统计数据 display saved-configuration #保存配置文件 display logbuffer #日志信息 display port trunk #查看参与 trunk 的端口 3、STP 信息检查 display stp root #查看 stp 根情况 display stp brief #查看 stp 简单信息 display stp abnormal-port #查看是否有非正常端口 display stp region-configuration #生成树区域配置 display lldp neighbor-information #查看链路层邻居发现协议(邻居信息) display tcp status #路由器设备命令—tcp统计数据 display tcp statistics #交换机设备命令—tcp统计数据 4、 vrrp 和端口聚合检查 display vrrp #查看虚拟路由冗余协议 display vrrp statistics #查看主备用状态 display link-aggregation summary #查看链路聚合组的情况 -

VNC一款超好用的局域网远程控制工具 VNC一款超好用的局域网远程控制工具 Vnc是一种远程桌面分享系统,它允许用户通过网络连接从另一台计算机控制另一台电脑的桌面环境。VNC基于RFB(Remote Framebuffer)协议,最初由AT&T的欧洲实验室于1998年开发。现在,VNC已经成为最流行的远程控制工具之一,被广泛应用于远程技术支持、远程工作、在线游戏以及访问受限的网络资源等场景。 安装步骤: 本软件分为服务端和客户端两部分。 服务端安装步骤 1.1首先解压压缩包,双击VNC-Server-6.7.2-Windows文件夹,然后打开VNC-Server-6.7.2-Windows.exe。 1.2 弹出的窗口选OK,然后点击next,新的界面先勾选再点击next。 1.3该窗口可以选择软件的安装路径,如果无特殊需求可以直接用默认的安装路径,点next;新弹出的窗口继续next;然后点击install。 1.4出现下图证明你的服务端已经安装成功了。 1.5该步骤是为服务器添加一个用于连接到这台主机的VNC账户密码,参考步骤如下图,执行完这5步后服务端就算彻底安装完毕了。 客户端安装 2.1打开文件夹VNC-Viewer-6.20.529-Windows,双击运行VNC-Viewer-6.20.529-Windows.exe;弹出的窗口点击ok 2.2到这里,客户端就算安装完毕了,下面进行客户端的使用操作 可以看到VNC已经远程成功了

VNC一款超好用的局域网远程控制工具 VNC一款超好用的局域网远程控制工具 Vnc是一种远程桌面分享系统,它允许用户通过网络连接从另一台计算机控制另一台电脑的桌面环境。VNC基于RFB(Remote Framebuffer)协议,最初由AT&T的欧洲实验室于1998年开发。现在,VNC已经成为最流行的远程控制工具之一,被广泛应用于远程技术支持、远程工作、在线游戏以及访问受限的网络资源等场景。 安装步骤: 本软件分为服务端和客户端两部分。 服务端安装步骤 1.1首先解压压缩包,双击VNC-Server-6.7.2-Windows文件夹,然后打开VNC-Server-6.7.2-Windows.exe。 1.2 弹出的窗口选OK,然后点击next,新的界面先勾选再点击next。 1.3该窗口可以选择软件的安装路径,如果无特殊需求可以直接用默认的安装路径,点next;新弹出的窗口继续next;然后点击install。 1.4出现下图证明你的服务端已经安装成功了。 1.5该步骤是为服务器添加一个用于连接到这台主机的VNC账户密码,参考步骤如下图,执行完这5步后服务端就算彻底安装完毕了。 客户端安装 2.1打开文件夹VNC-Viewer-6.20.529-Windows,双击运行VNC-Viewer-6.20.529-Windows.exe;弹出的窗口点击ok 2.2到这里,客户端就算安装完毕了,下面进行客户端的使用操作 可以看到VNC已经远程成功了 -

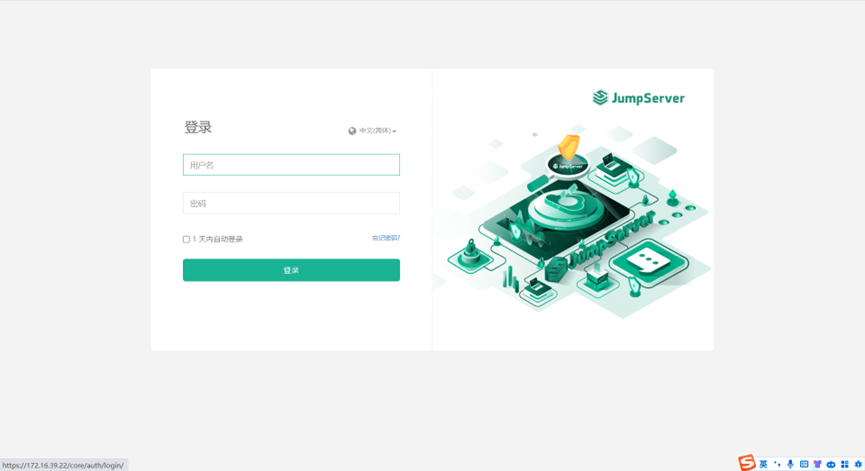

Jumper server 使用指导书 浏览器打开: https://堡垒机IP 登录jumper server堡垒机 ——下图表示登录成功,来到个人首页 点击”个人信息”旁切换按钮,切换到”工作台”,再点击“我的资产”,右侧就能看到此账号所授权的资产 点击资产右侧的“>_“会跳转到以下界面,点击连接,就可以直接远程到对应的资产 完成 文件上传 点击文件管理就能看到文件上传按钮 点击即可上传文件 文件下载: 在服务器文件管理器点击JumpServer-Lion 进入到\tsclient\JumpServer\Download目录 把文件拖拽进这个目录即可下载对应文件 复制粘贴使用 本地复制文本后点击剪切板即可复制进服务器内 Linux文件管理⚓︎ 1 批量传输⚓︎ • JumpServer 支持对文件进行批量传输,即将本地文件批量的上传到多个JumpServer纳管的资产中。 2 文件管理⚓︎ • 文件管理是传输文件的一种方式,上传下载默认 SFTP 目录默认为/tmp 路径。 • SFTP 目录与资产平台进行绑定,JumpServer 默认平台的 SFTP 目录无法修改(需联系管理员操作修改) 2.1 页面使用⚓︎ • 点击左侧节点树对应资产,即可进入资产中的 SFTP 目录。 • 进入 SFTP 目录后,即可对文件夹或文件对应操作。 • 操作方式支持两种,第一种方式:直接在右侧页面右击唤出操作菜单;第二种方式:上方黑色部分的按钮进行对应的操作。

Jumper server 使用指导书 浏览器打开: https://堡垒机IP 登录jumper server堡垒机 ——下图表示登录成功,来到个人首页 点击”个人信息”旁切换按钮,切换到”工作台”,再点击“我的资产”,右侧就能看到此账号所授权的资产 点击资产右侧的“>_“会跳转到以下界面,点击连接,就可以直接远程到对应的资产 完成 文件上传 点击文件管理就能看到文件上传按钮 点击即可上传文件 文件下载: 在服务器文件管理器点击JumpServer-Lion 进入到\tsclient\JumpServer\Download目录 把文件拖拽进这个目录即可下载对应文件 复制粘贴使用 本地复制文本后点击剪切板即可复制进服务器内 Linux文件管理⚓︎ 1 批量传输⚓︎ • JumpServer 支持对文件进行批量传输,即将本地文件批量的上传到多个JumpServer纳管的资产中。 2 文件管理⚓︎ • 文件管理是传输文件的一种方式,上传下载默认 SFTP 目录默认为/tmp 路径。 • SFTP 目录与资产平台进行绑定,JumpServer 默认平台的 SFTP 目录无法修改(需联系管理员操作修改) 2.1 页面使用⚓︎ • 点击左侧节点树对应资产,即可进入资产中的 SFTP 目录。 • 进入 SFTP 目录后,即可对文件夹或文件对应操作。 • 操作方式支持两种,第一种方式:直接在右侧页面右击唤出操作菜单;第二种方式:上方黑色部分的按钮进行对应的操作。 -

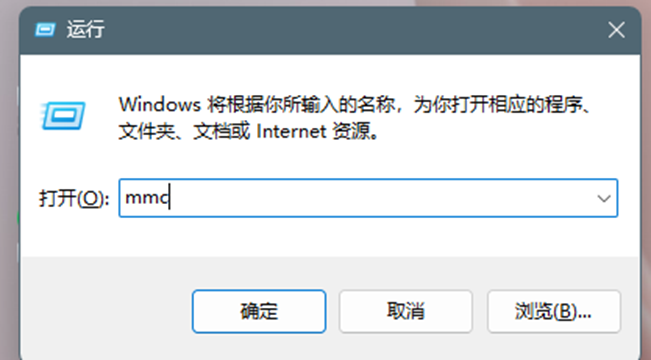

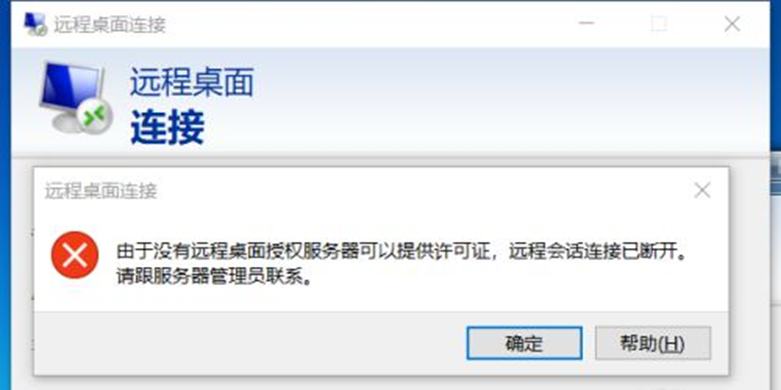

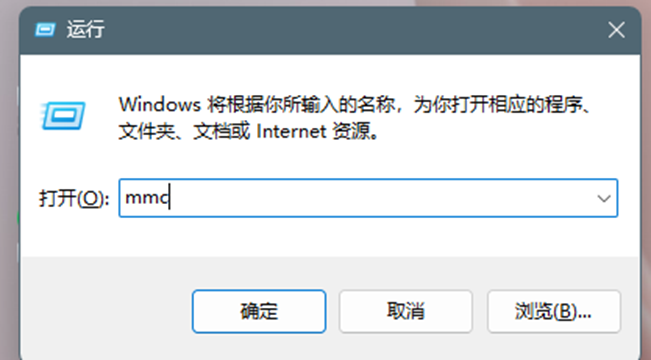

Exchange 2013/2016安装SSL证书步骤 Exchange分为2013和2016版,安装SSL证书的步骤教程大致相同,主要分为导入SSL证书、绑定SSL证书2大步骤,您可以参考以下步骤为Exchange 2013/2016安装SSL证书。 一、导入SSL证书 1、首先需要导入SSL证书,键盘同时按住 win+r 进入运行对话框,在运行对话框中输入“mmc”,点击“确定”进入控制台 2、在控制台界面依次点击“文件”-“添加/删除管理单元” 3、然后选择“证书”,点击“添加”进入证书管理单元 4、在证书管理单元选择“计算机账户”,然后点击“下一页” 5、选择计算机默认,然后进入下一步 6、在“个人”-“证书”处右击,选择“所有任务”-“导入”进入证书导入向导界面 7、在证书导入向导界面中选择“浏览” 8、随后选择我们提供的压缩包里IIS文件夹中的pfx格式的证书,例如“racent_com.pfx” 9、输入IIS文件夹中password文件中的密码,然后点击“下一页” 10、选中“将所有的证书都放入下列存储”,然后证书储存设置为“个人”,然后点击“下一页” 11、这样就导入SSL证书了,导入成功后会显示完整的三个证书 二、绑定SSL证书 1、接下来要绑定应用您的SSL证书,请返回到Exchange管理中心。在“服务器”-“证书”中,选择正确服务器,找到导入的证书,选择该证书,点击“编辑” 2、随后单击左侧的“服务Services”按钮,选择要使用证书服务,单击“保存save”按钮即可 以上步骤操作完毕,现在,您的证书已成功安装并启用。

Exchange 2013/2016安装SSL证书步骤 Exchange分为2013和2016版,安装SSL证书的步骤教程大致相同,主要分为导入SSL证书、绑定SSL证书2大步骤,您可以参考以下步骤为Exchange 2013/2016安装SSL证书。 一、导入SSL证书 1、首先需要导入SSL证书,键盘同时按住 win+r 进入运行对话框,在运行对话框中输入“mmc”,点击“确定”进入控制台 2、在控制台界面依次点击“文件”-“添加/删除管理单元” 3、然后选择“证书”,点击“添加”进入证书管理单元 4、在证书管理单元选择“计算机账户”,然后点击“下一页” 5、选择计算机默认,然后进入下一步 6、在“个人”-“证书”处右击,选择“所有任务”-“导入”进入证书导入向导界面 7、在证书导入向导界面中选择“浏览” 8、随后选择我们提供的压缩包里IIS文件夹中的pfx格式的证书,例如“racent_com.pfx” 9、输入IIS文件夹中password文件中的密码,然后点击“下一页” 10、选中“将所有的证书都放入下列存储”,然后证书储存设置为“个人”,然后点击“下一页” 11、这样就导入SSL证书了,导入成功后会显示完整的三个证书 二、绑定SSL证书 1、接下来要绑定应用您的SSL证书,请返回到Exchange管理中心。在“服务器”-“证书”中,选择正确服务器,找到导入的证书,选择该证书,点击“编辑” 2、随后单击左侧的“服务Services”按钮,选择要使用证书服务,单击“保存save”按钮即可 以上步骤操作完毕,现在,您的证书已成功安装并启用。